De vivir más a vivir mejor: IA para el envejecimiento saludable

Vivir más ya no parece suficiente. Descubre cómo la inteligencia artificial comienza a redefinir el envejecimiento saludable, impulsando nuevas formas de prevenir, acompañar y añadir…

Proteger sistemas digitales solía depender de perímetros, firmas y análisis humano bajo presión. Hoy, la inteligencia artificial detecta anomalías, prioriza alertas y contiene ataques en segundos. Pero esta aceleración tiene una contracara: la misma tecnología que fortalece la defensa amplifica la escala y sofisticación del ataque, convirtiendo la ciberseguridad en una competencia permanente entre algoritmos.

En los últimos años, la ciberseguridad se ha vuelto progresivamente más compleja. Durante mucho tiempo fue concebida como un problema técnico que podía resolverse con firewalls, antivirus y equipos especializados operando en segundo plano. Hoy ese enfoque perimetral resulta insuficiente frente a un entorno digital interconectado y dinámico. Este cambio responde a la convergencia de factores que han transformado tanto la naturaleza de las amenazas como el contexto en el que se producen.

El aumento de las tensiones geopolíticas ha trasladado parte de la competencia estratégica al ciberespacio, generando un entorno donde los ciberataques operan como instrumentos de presión económica y política.

Paralelamente, la creciente integración de cadenas de suministro digitales ha creado arquitecturas interdependientes, donde una vulnerabilidad aislada puede desencadenar efectos sistémicos en múltiples organizaciones.

A esta interdependencia se suma la adopción acelerada de tecnologías emergentes, en particular la Inteligencia Artificial, que está siendo utilizada para automatizar procesos, personalizar campañas y optimizar la evasión de controles de seguridad. Como consecuencia, los actores maliciosos pueden desplegar campañas coordinadas con mayor rapidez, personalización, y menor coste operativo, lo que incrementa su capacidad de alcance.[1]

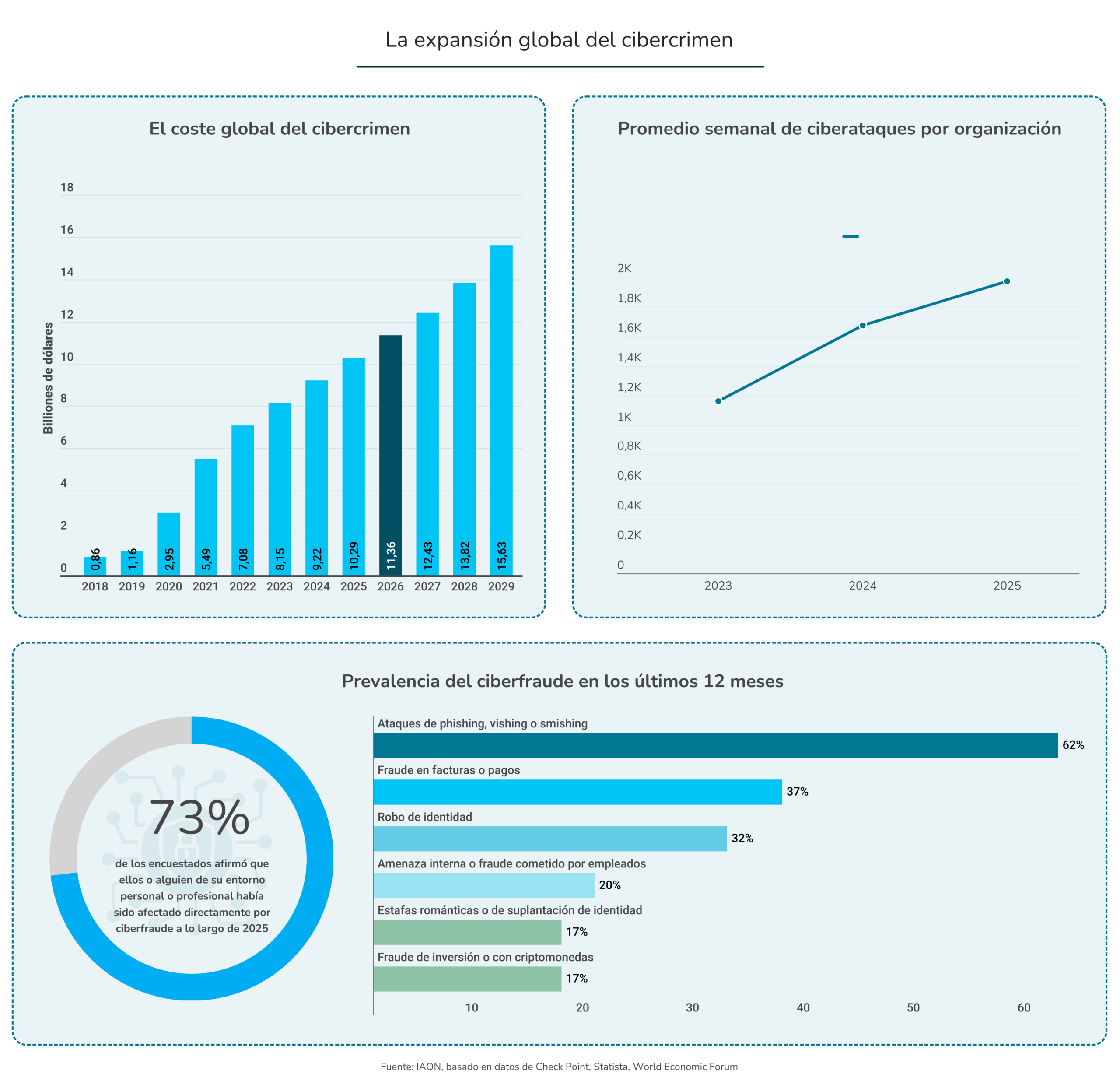

Por ello, los ciberataques no solo evolucionan en sofisticación técnica, sino que también aumentan en volumen. El promedio semanal de ataques por organización a nivel global pasó de 1.162 en 2023 a 1.968 en 2025, lo que representa un crecimiento interanual del 18%. La progresión sostenida de estas cifras indica que la presión sobre las infraestructuras digitales responde a una dinámica estructural, no a episodios aislados.[2]

El impacto económico refleja la misma dinámica. El coste global del cibercrimen pasó de 0,86 billones de dólares en 2018 a 9,22 billones de dólares en 2024, con una proyección de 15,63 billones de dólares en 2029.[3] La magnitud y la velocidad de este crecimiento evidencian que el cibercrimen no solo aumenta en escala, sino que genera un coste económico creciente y sostenido para empresas, gobiernos y ciudadanos.

Además, el riesgo digital ya forma parte de la experiencia cotidiana de la mayoría de las personas. En una encuesta del World Economic Forum, el 73% de los encuestados indicó que ellos o alguien de su red personal o profesional había sido afectado por fraude digital durante 2025.[4]

Entre los tipos de fraude más citados se encuentran el phishing y sus variantes, mencionados por el 62%, el fraude en facturas o pagos, con un 37%, y el robo de identidad, con un 32%.[5] La incidencia transversal de estos delitos confirma que la ciberseguridad se ha convertido en una cuestión de alcance social, no exclusivamente organizacional.

Ante este entorno caracterizado por mayor interconexión, mayor volumen de ataques y mayor sofisticación técnica, emerge un factor determinante: la inteligencia artificial. El 87% de los encuestados la identifica como el riesgo cibernético de más rápido crecimiento en 2025, y el 94% anticipa que será el principal motor de transformación de la ciberseguridad en 2026.[6]

Estas cifras reflejan que la IA no es percibida como una amenaza marginal, sino como el elemento que está redefiniendo el equilibrio entre ataque y defensa en el ecosistema digital. La IA tiene un efecto dual. Por un lado, su integración masiva en procesos empresariales y sistemas digitales amplía la superficie de ataque y genera nuevas categorías de vulnerabilidad. Al mismo tiempo, los actores maliciosos la utilizan para automatizar y escalar sus operaciones, incrementando la precisión y el alcance de los ataques.

Por otro lado, en un entorno donde cada organización enfrenta cerca de 2.000 intentos de ataque semanales, la defensa basada exclusivamente en procesos manuales resulta inviable. La capacidad de analizar grandes volúmenes de datos, identificar patrones complejos y responder en tiempo real requiere automatización inteligente. En este contexto, la inteligencia artificial se convierte en infraestructura necesaria para sostener la resiliencia.[7]

La inteligencia artificial está redefiniendo el equilibrio operativo de la ciberseguridad. Amplifica la escala y precisión de los ataques, al tiempo que se consolida como componente estructural de los sistemas de detección y respuesta.

Esta dinámica configura un entorno de competencia tecnológica continua, donde la misma tecnología que habilita nuevas amenazas se convierte en requisito para contenerlas.

La inteligencia artificial también desempeña un papel dual en el actual ecosistema de amenazas. Por un lado, se ha convertido en un objetivo estratégico a medida que los sistemas de IA se integran de forma transversal en los procesos empresariales.

Asistentes inteligentes y agentes autónomos procesan correos electrónicos, documentos, calendarios, bases de conocimiento internas y contenidos web, concentrando acceso a datos sensibles y a sistemas interconectados.

A medida que se acelera su adopción, también se amplía su exposición. El incremento del acceso a información crítica convierte a los sistemas de IA en una superficie de ataque cada vez más atractiva. Servicios basados en modelos y arquitecturas agentivas introducen nuevos vectores de riesgo, donde la manipulación de prompts, configuraciones vulnerables o fallos en herramientas conectadas pueden generar oportunidades de explotación.

Por otro lado, la IA funciona como amplificador de capacidades ofensivas. Los actores maliciosos la utilizan para incrementar la escala, la velocidad, la precisión y la sofisticación de sus operaciones, impulsando una nueva generación de explotación automatizada y de ingeniería social altamente dirigida.

La disponibilidad masiva de sistemas de IA introduce un nivel de escalabilidad que transforma la economía del cibercrimen y reduce las barreras técnicas de entrada.[8] Desde esta doble perspectiva, la IA no solo redefine qué se ataca, sino también cómo se ataca.

Los actores maliciosos ya no se limitan a comprometer infraestructuras tradicionales, sino que dirigen sus esfuerzos a los datos que entrenan los modelos y a la lógica que define su comportamiento. Al intervenir en estos componentes, pueden alterar resultados, inducir errores sistemáticos, extraer información sensible, propagar desinformación o incluso provocar la ejecución de acciones no autorizadas en sistemas conectados.

Estas amenazas pueden materializarse en distintas etapas del ciclo de vida de la inteligencia artificial. Mientras el envenenamiento de datos actúa durante la fase de entrenamiento, modificando los datos que moldean el aprendizaje del modelo, las inyecciones de prompts operan en tiempo de uso, manipulando las instrucciones que recibe el sistema para alterar su comportamiento operativo.[9]

El envenenamiento de datos es una forma de ataque en la que los actores maliciosos manipulan o corrompen los datos utilizados para entrenar sistemas de inteligencia artificial, permitiendo a los atacantes influir en el comportamiento de un modelo de distintas maneras.

En algunos casos, la manipulación se orienta a provocar un efecto específico: por ejemplo, introducir datos alterados en un sistema de detección de malware para que deje de identificar determinadas amenazas, o modificar el aprendizaje de un modelo conversacional para que genere respuestas sesgadas o alineadas con un interés particular. El sistema continúa funcionando y aparenta normalidad, pero sus decisiones han sido sutilmente condicionadas.

En otros escenarios, el objetivo no es modificar una salida concreta, sino erosionar la robustez general del modelo. Al contaminar el conjunto de datos de entrenamiento con información incorrecta o contradictoria, se degrada su capacidad para interpretar señales, clasificar eventos o reconocer patrones con precisión. En entornos críticos, esta pérdida de robustez puede traducirse en errores sistemáticos en la interpretación de entradas, facilitando ataques posteriores que explotan esas debilidades.

En ambos casos, la consecuencia es similar: el modelo deja de ser un sistema confiable y predecible, y pasa a operar bajo parámetros alterados que el atacante puede aprovechar progresivamente.[10]

Entre las vulnerabilidades emergentes de los sistemas generativos, la inyección de prompts ocupa el primer lugar en el OWASP Top 10 para aplicaciones con LLM. Se trata de un ataque en el que el adversario introduce instrucciones maliciosas que aparentan ser legítimas, buscando alterar el comportamiento previsto del modelo.

En su forma más básica, una inyección de prompts puede lograr que un chatbot ignore las restricciones definidas por sus desarrolladores y genere contenido que no debería producir. Sin embargo, el riesgo se amplifica cuando el modelo no solo genera texto, sino que además tiene acceso a información sensible o está integrado mediante APIs a otros sistemas.

Por ejemplo, un asistente basado en LLM capaz de redactar correos electrónicos o editar archivos podría, mediante una instrucción cuidadosamente diseñada, ser inducido a reenviar documentos confidenciales o ejecutar acciones no autorizadas.

La vulnerabilidad técnica se origina en la forma en que se construyen muchas aplicaciones basadas en LLM, que operan a partir de instrucciones en lenguaje natural. Los desarrolladores establecen un conjunto de reglas mediante un “prompt de sistema”, donde definen qué debe hacer el modelo y qué comportamientos debe evitar. Cuando el usuario interactúa con la aplicación, su entrada se añade a esas instrucciones y todo se envía como un único bloque de texto al modelo.

El problema radica en que el sistema no distingue estructuralmente entre instrucciones del desarrollador e instrucciones del usuario: ambas son texto en lenguaje natural. Si el atacante formula su entrada de manera que parezca una instrucción prioritaria, puede lograr que el modelo ignore las reglas originales y actúe conforme a la nueva indicación.

Estas manipulaciones pueden producirse de forma directa, cuando el atacante controla explícitamente la entrada que recibe el modelo, o de forma indirecta, cuando la instrucción maliciosa se oculta en contenidos externos que el sistema procesa.[11]

La inteligencia artificial no origina el cibercrimen, pero amplifica su escala, acelera su ejecución y eleva la sofisticación y precisión de los ataques, impulsando una nueva generación de explotación automatizada y de ingeniería social altamente dirigida.

Según el World Economic Forum, el uso ofensivo de la IA se concentra actualmente en dos ámbitos principales: la ingeniería social y el reconocimiento previo al ataque.[12]

La ingeniería social consiste en inducir a personas a realizar acciones específicas, como revelar credenciales, abrir archivos, transferir fondos o facilitar información confidencial. El mecanismo central no es técnico, sino psicológico: explotar la confianza, la urgencia o la autoridad percibida. Para ello, los atacantes suelen suplantar identidades conocidas, como un superior jerárquico, un proveedor, una entidad financiera o incluso un familiar, con el fin de aumentar la probabilidad de éxito.[13]

Lo que ha cambiado no es la lógica del engaño, sino la capacidad de industrializarlo. La inteligencia artificial está amplificando la velocidad, el alcance y la sofisticación de estas campañas, transformando una práctica artesanal en una operación escalable.[14]

El uso criminal de IA no solo ha incrementado la eficiencia del cibercrimen, sino que ha reducido las barreras de entrada para actores con menor especialización técnica. La IA permite traducir y localizar campañas en múltiples idiomas y contextos culturales, haciendo que las suplantaciones resulten más verosímiles en regiones que anteriormente no eran objetivo prioritario. Asimismo, modelos entrenados con datos comprometidos pueden replicar estilos de comunicación auténticos, incrementando la precisión en la manipulación de la confianza.[15]

Según el World Economic Forum, el phishing automatizado mediante modelos de lenguaje puede reducir los costes de ejecución en más de 95%, manteniendo o incluso superando las tasas de éxito previas. En coherencia con esta tendencia, en 2024 el 42% de las organizaciones reportó incidentes vinculados a phishing e ingeniería social, evidenciando la expansión de estas técnicas.[16]

Dentro de esta categoría, dos vectores concentran el impacto actual: el phishing automatizado y los deepfakes.

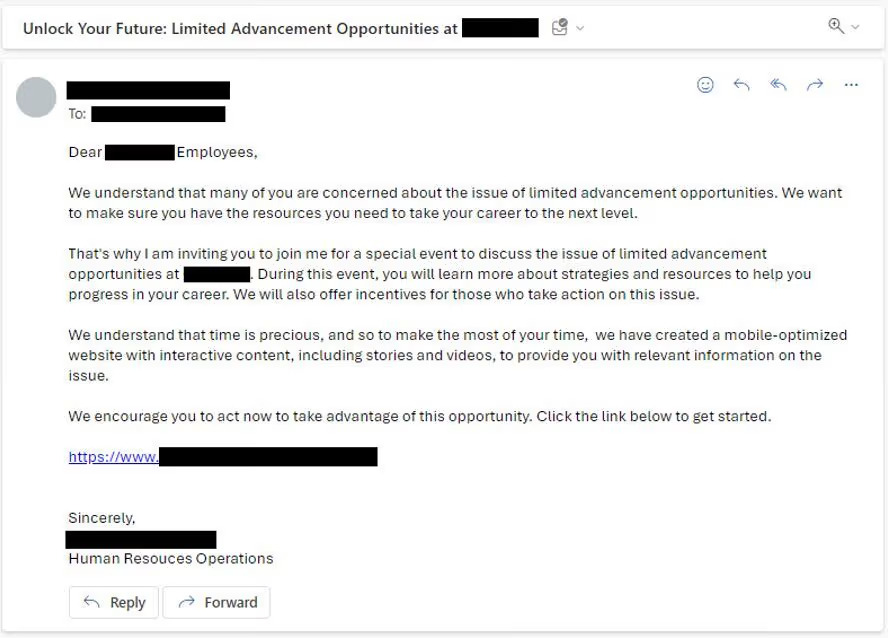

El phishing consiste en suplantar a una entidad legítima con el objetivo de inducir a la víctima a revelar información confidencial o ejecutar una acción perjudicial.[17] Tradicionalmente, estos ataques comenzaban con un correo o mensaje que simulaba provenir de una institución confiable y generaba un sentido de urgencia para que el usuario hiciera clic en un enlace o descargara un archivo malicioso[18].

La incorporación de inteligencia artificial ha alterado de forma significativa esta dinámica. Según ENISA, más del 80% de los correos de phishing identificados entre septiembre de 2024 y febrero de 2025 incorporaron algún grado de uso de IA, lo que indica que su adopción ofensiva ya no es marginal, sino predominante.[19]

Los modelos de lenguaje de gran escala permiten generar mensajes masivos, semiautomatizados y personalizados en tiempos mínimos. Mientras un operador humano podría dedicar 30 minutos a redactar un único mensaje convincente, un modelo puede producir cientos de variaciones únicas en el mismo intervalo. La automatización ya no implica uniformidad, sino personalización a escala.

Fuente: IBM X-Force

Además, la IA facilita la integración contextual en tiempo real, incorporando noticias corporativas, eventos recientes o referencias individualizadas que incrementan la plausibilidad del mensaje. Los correos pueden incluir detalles aparentemente familiares, como compras recientes, intereses específicos o interacciones digitales previas, que refuerzan la percepción de autenticidad.

El resultado es una combinación de volumen, personalización y realismo, que incrementa la probabilidad de éxito del ataque y reduce la capacidad de detección basada en patrones repetitivos.[20]

El segundo vector relevante es el uso de deepfakes, que emplean inteligencia artificial para generar contenidos audiovisuales sintéticos con un nivel de realismo suficiente para simular identidades legítimas. A diferencia del phishing textual, aquí el elemento persuasivo no es solo el mensaje, sino la aparente autenticidad de la voz o la imagen.

Estas tecnologías permiten recrear la voz de un directivo, generar un vídeo que simula una videollamada corporativa o construir perfiles digitales que aparentan pertenecer a empresas reales.

En entornos corporativos, un deepfake de voz puede, por ejemplo, utilizarse para solicitar de forma urgente una transferencia financiera, replicando el tono y estilo de comunicación de un superior jerárquico. En otros casos, puede inducir a la revelación de credenciales estratégicas o facilitar la desactivación de mecanismos de autenticación multifactor bajo un pretexto verosímil. La combinación de urgencia y reconocimiento de identidad incrementa la probabilidad de que la víctima actúe sin verificar.

En el ámbito del consumidor, la misma lógica se traslada a estafas de soporte técnico o suplantaciones de entidades financieras, donde la voz sintética refuerza la credibilidad del engaño.

Más allá del fraude financiero directo, los deepfakes también pueden emplearse para manipulación informativa en contextos de crisis, espionaje corporativo o extorsión mediante la generación de contenido íntimo no consentido.

En conjunto, la ingeniería social potenciada por IA consolida una tendencia clara: la automatización no sustituye la manipulación humana, pero la amplifica, permitiendo ataques más personalizados, menos costosos y más difíciles de detectar.[21]

Fuente: LipSynthesis

El segundo ámbito donde la inteligencia artificial está modificando el equilibrio ofensivo es el reconocimiento previo al ataque. Esta fase constituye el punto de partida de cualquier intrusión: consiste en recopilar información sobre la arquitectura tecnológica de un objetivo, sus sistemas expuestos, configuraciones, proveedores y posibles vulnerabilidades, todo ello procurando permanecer sin ser detectado.[22]

La incorporación de IA ha transformado este proceso en una capacidad automatizada y escalable. Mediante técnicas de scraping y análisis automatizado, los atacantes pueden examinar grandes volúmenes de datos procedentes de redes sociales, registros públicos, tráfico de red o información corporativa abierta, correlacionando patrones con mayor velocidad y precisión que los métodos manuales.

Por ejemplo, los sistemas basados en IA pueden mapear estructuras organizativas, detectar configuraciones débiles y anticipar posibles comportamientos defensivos, optimizando la selección del objetivo antes de ejecutar el ataque.

Un ámbito especialmente crítico es la identificación de vulnerabilidades no documentadas, conocidas como zero-days. La IA permite acelerar la detección de fallos aún no parcheados y facilitar la generación de código capaz de explotarlos antes de que exista una solución disponible. Investigaciones recientes han mostrado que múltiples modelos avanzados pueden operar de forma coordinada para identificar y explotar este tipo de vulnerabilidades de manera autónoma.

Este proceso permite incluso crear malware personalizado capaz de explotar estas debilidades antes de que se desplieguen los parches correspondientes, ampliando la ventana de exposición para las organizaciones afectadas.[23]

El resultado es una fase de reconocimiento más rápida, más precisa y menos visible. La IA no sustituye la lógica estratégica del atacante, pero reduce el coste y el tiempo necesarios para preparar operaciones altamente dirigidas, incrementando la probabilidad de éxito en las fases posteriores del ataque.

La inteligencia artificial aplicada a la ciberseguridad consiste en el uso de algoritmos avanzados y técnicas de aprendizaje automático para fortalecer la prevención, identificación y gestión de amenazas digitales. Su principal ventaja radica en la capacidad de analizar volúmenes masivos de datos, identificar patrones complejos y tomar decisiones informadas a una velocidad y escala que exceden las capacidades humanas.[24]

Este enfoque está transformando las operaciones de seguridad en tres dimensiones clave: aceleración de la detección de amenazas, optimización del triage y priorización de alertas, y automatización de la respuesta ante incidentes.

Paralelamente, la IA asume tareas operativas intensivas en tiempo, como el análisis de logs, la clasificación de vulnerabilidades o la generación de reportes de cumplimiento, liberando a los equipos humanos para concentrarse en actividades estratégicas, supervisión crítica y toma de decisiones complejas. [25]

En lugar de sustituir a los profesionales, la IA redefine el modelo operativo de defensa, transitando desde una postura reactiva basada en firmas conocidas hacia un enfoque adaptativo basado en el análisis de comportamientos y anomalías.

Los sistemas tradicionales de seguridad, como los primeros antivirus o los sistemas de detección de intrusiones, se basaban en mecanismos de detección por firmas. Estos modelos comparan archivos o paquetes de red con una base de datos de patrones previamente identificados. Cuando existe coincidencia, se genera una alerta.

El límite estructural de este enfoque es su carácter reactivo: solo identifica amenazas que ya han sido catalogadas. Frente a vulnerabilidades desconocidas o ataques inéditos, como los denominados zero-day, estos mecanismos resultan insuficientes.

La incorporación de inteligencia artificial modifica esta lógica. En lugar de depender exclusivamente de firmas estáticas, los modelos de aprendizaje automático analizan grandes volúmenes de eventos procedentes de registros de firewall, actividad en endpoints, tráfico de red, alertas de sistema y fuentes externas de inteligencia de amenazas. A partir de estos datos, los sistemas identifican patrones, detectan anomalías y asignan niveles de riesgo que permiten priorizar alertas.

Este proceso combina técnicas de aprendizaje supervisado, no supervisado y modelos avanzados capaces de correlacionar múltiples señales. El resultado es una capacidad de identificación de comportamientos atípicos en tiempo real, incluso cuando no existe una firma previa asociada al ataque.

Una vez identificados los patrones de comportamiento, la IA clasifica y prioriza incidentes según su criticidad, ejecutando un proceso de triaje automatizado que contribuye a reducir el volumen de falsos positivos y orientando la atención humana hacia los eventos con mayor probabilidad de impacto. La supervisión final sigue recayendo en analistas, cuyo criterio permite validar decisiones y retroalimentar el sistema.

De este modo, la detección evoluciona desde un modelo estático basado en coincidencias conocidas hacia una capacidad adaptativa sustentada en el análisis continuo de datos y en la priorización automatizada de riesgos.[26]

La aplicación de inteligencia artificial en la fase de respuesta introduce un cambio estructural en la forma en que las organizaciones contienen incidentes. La capacidad de actuar en segundos, una vez confirmado o altamente probable un compromiso, reduce la ventana de explotación disponible para el atacante.

Cada vez más organizaciones incorporan agentes de IA capaces de operar en entornos de identidad y sistemas críticos con supervisión humana mínima. Cuando múltiples señales de alto riesgo indican, por ejemplo, la posible toma de control de una cuenta, el agente puede suspenderla de forma inmediata, iniciar un restablecimiento de credenciales y notificar a los administradores, conteniendo el incidente antes de que el atacante escale privilegios.

Paralelamente, estos sistemas realizan tareas de mantenimiento preventivo continuo, corrigiendo configuraciones débiles y reduciendo la superficie de exposición.[27]

Un ámbito especialmente relevante es la ciberseguridad basada en engaño. La integración de modelos de lenguaje de gran escala en entornos señuelo permite generar interacciones dinámicas que simulan sistemas legítimos con alto grado de realismo.

A diferencia de configuraciones estáticas, los LLM pueden producir respuestas contextuales y coherentes en tiempo real, prolongando la interacción con el atacante. Esta simulación controlada facilita que el actor malicioso revele intenciones, tácticas y procedimientos mientras cree estar avanzando en su intrusión.

Además, los modelos pueden generar activos señuelo verosímiles – credenciales ficticias, configuraciones plausibles o contenidos que imitan datos sensibles, reforzando la credibilidad del entorno simulado.[28]

El resultado es una respuesta que no solo bloquea, sino que observa, aprende y gana tiempo, integrando contención operativa y obtención de inteligencia en un mismo proceso.

Más allá de la detección y la respuesta, la inteligencia artificial está redefiniendo la gestión cotidiana de la seguridad. La automatización de tareas rutinarias permite aplicar controles básicos de forma consistente, reduciendo la dependencia de procesos manuales y el riesgo de error humano.

Sistemas basados en IA pueden ejecutar de manera continua actividades como la gestión de parches, el escaneo de malware o la monitorización de red, asegurando que vulnerabilidades conocidas se corrijan y que configuraciones críticas se mantengan actualizadas.

En lugar de depender de intervenciones puntuales, estos mecanismos operan de forma persistente, integrando el mantenimiento en el funcionamiento normal de la infraestructura. Por ejemplo, la actualización de software a escala organizacional, una tarea que manualmente requeriría coordinación, tiempo y recursos significativos, puede ejecutarse de forma automatizada y simultánea.

Esta eficiencia no solo fortalece la postura de seguridad, sino que libera capacidad especializada para abordar amenazas complejas, investigación avanzada y decisiones estratégicas. La automatización no sustituye el criterio humano, pero estabiliza el nivel base de protección, creando un entorno más resiliente frente a fallos operativos y reduciendo la acumulación de riesgos latentes.[29]

La inteligencia artificial no introduce una amenaza aislada, sino una transformación estructural del ecosistema de ciberseguridad. Amplía las superficies de exposición, acelera la capacidad ofensiva y, simultáneamente, redefine los modelos de defensa. La competencia ya no se produce únicamente entre organizaciones y atacantes, sino entre sistemas algorítmicos capaces de aprender, adaptarse y escalar.

En este nuevo entorno, la cuestión central para las organizaciones deja de ser si incorporar inteligencia artificial en sus estrategias de seguridad y pasa a ser cómo integrarla de forma estructural en su arquitectura de defensa.

La aceleración de ataques potenciados por inteligencia artificial está obligando a las organizaciones a revisar sus estrategias de seguridad. Cuando los actores maliciosos operan con automatización, escalabilidad y aprendizaje continuo, las defensas tradicionales resultan estructuralmente insuficientes, lo que exige soluciones tecnológicas de mayor sofisticación.

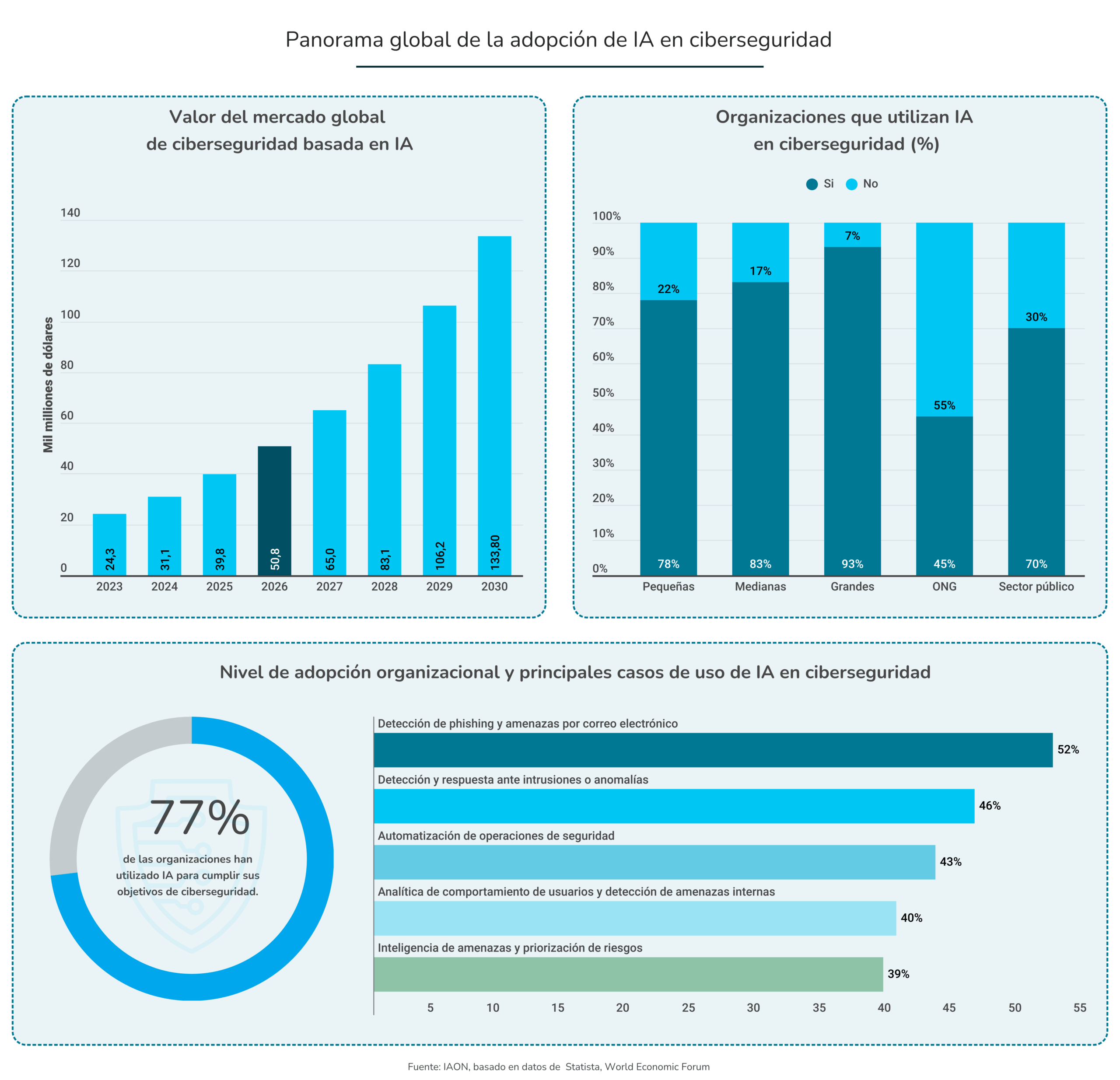

Esta presión se refleja en la inversión. El mercado global de ciberseguridad basada en inteligencia artificial, valorado en 24,30 mil millones de dólares en 2023, se proyecta que alcance aproximadamente 133,8 mil millones de dólares en 2030. La magnitud de este crecimiento no responde a una tendencia tecnológica pasajera, sino a la necesidad operativa de sostener capacidades defensivas en un entorno de amenazas algorítmicas.[30]

A nivel organizacional, la adopción ya es significativa. Según World Economic Forum, el 77% de las organizaciones declara haber incorporado inteligencia artificial en sus funciones de ciberseguridad. Su uso se concentra en la detección de phishing (52%), la identificación y respuesta frente a intrusiones y anomalías (46%) y en la automatización de operaciones de seguridad (40%).[31]

La IA se integra allí donde el volumen de eventos, la presión temporal y la complejidad técnica superan los límites del análisis manual. Más que una mejora incremental, su adopción responde a una necesidad estructural de eficiencia, priorización automatizada y reducción del tiempo de respuesta en entornos de amenaza persistente.

Sin embargo, esta adopción no es homogénea. Las organizaciones con mayores ingresos tienden a liderar la incorporación de herramientas avanzadas de detección y automatización, mientras que entidades con recursos limitados, administraciones públicas y organizaciones sin fines de lucro muestran tasas de adopción inferiores. La asimetría tecnológica introduce una nueva brecha de resiliencia, donde la capacidad de defensa depende cada vez más del acceso a tecnología, datos y talento especializado.

En ecosistemas interconectados, esta brecha trasciende a la organización individual. Las cadenas de suministro digitales amplifican la exposición sistémica: una vulnerabilidad en un proveedor puede convertirse en el punto de entrada hacia organizaciones de mayor valor aguas abajo. La seguridad deja de ser una cuestión aislada y pasa a depender del nivel de madurez del conjunto del ecosistema.

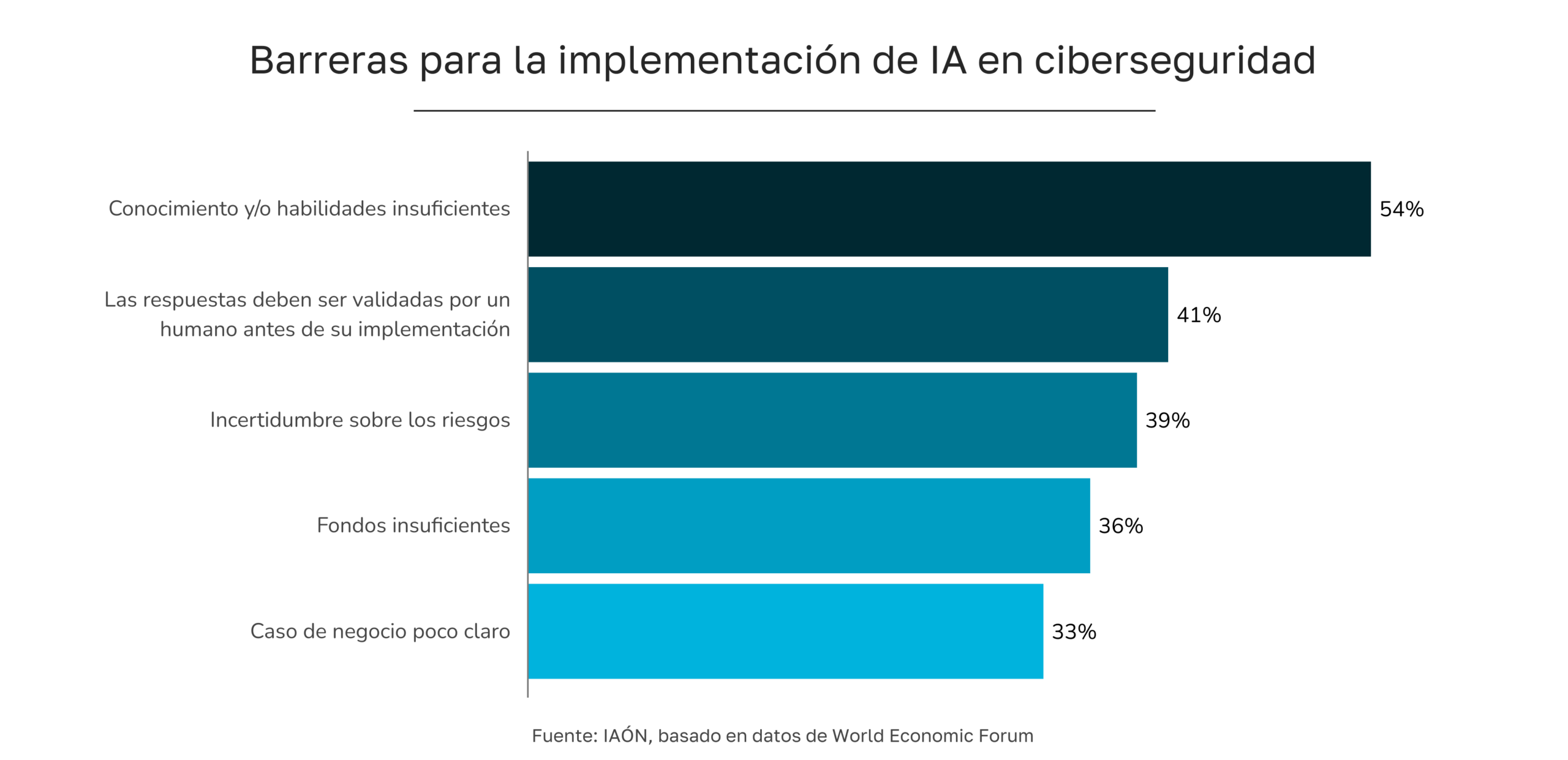

A la vez, la adopción de IA enfrenta obstáculos operativos. Las organizaciones identifican como principales barreras la falta de conocimiento o habilidades para desplegar IA en ciberseguridad (54%), la necesidad de supervisión humana (41%) y la incertidumbre respecto a los riesgos asociados (39%).[32]

Estos datos indican que el equilibrio entre automatización y juicio humano se vuelve central. La inteligencia artificial destaca en tareas repetitivas y de alto volumen, pero mantiene limitaciones en juicio contextual y toma de decisiones estratégicas. Una automatización sin marcos de control adecuados puede generar puntos ciegos explotables, especialmente cuando los sistemas operan con autonomía creciente.

Este cambio también redefine el perfil profesional requerido. Según el Future of Jobs Report 2025 del World Economic Forum, “redes y ciberseguridad” se sitúa entre las tres competencias de más rápido crecimiento proyectadas hacia 2030, junto con inteligencia artificial, big data y alfabetización tecnológica.

La transformación no implica sustitución, sino reconfiguración: los especialistas desplazan su foco hacia supervisión estratégica, gobernanza y validación, mientras delegan tareas operativas en sistemas automatizados.[33]

En consecuencia, las prioridades de las organizaciones se redefinen con claridad: invertir en formación en IA y en habilidades de uso seguro, e integrar mecanismos sólidos de gobernanza y validación, evitando al mismo tiempo la creación de nuevos puntos únicos de fallo que concentren riesgo sistémico.

En 2025, Microsoft Threat Intelligence detectó y bloqueó una campaña de phishing orientada al robo de credenciales que presentaba indicios de haber sido desarrollada con asistencia de modelos de lenguaje de gran escala (LLM). El ataque utilizaba código sintético para ofuscar su funcionalidad y evadir defensas tradicionales basadas en análisis estático.

El vector principal consistía en un archivo SVG adjunto a un correo electrónico que simulaba una notificación legítima de compartición de documentos. Aunque el archivo aparentaba ser un PDF, su estructura permitía incrustar código ejecutable.

La carga maliciosa no estaba cifrada mediante técnicas criptográficas convencionales, sino camuflada dentro de terminología empresarial y estructuras que imitaban paneles de análisis de negocio. Esta funcionalidad ofuscada incluía la redirección del navegador hacia una página inicial de phishing, la activación de mecanismos de browser fingerprinting y el seguimiento de sesión para perfilar a la víctima antes de desplegar la fase final del ataque.

A pesar del uso de IA para ofuscar la carga maliciosa, la campaña fue bloqueada por Microsoft Defender for Office 365 mediante un análisis combinado de infraestructura, indicadores de comportamiento y contexto del mensaje, dimensiones que no se vieron afectadas por la generación sintética del código.

Entre las señales que activaron la detección se encontraron el uso de correos auto enviados con destinatarios en copia oculta, un tipo y nombre de archivo sospechoso, redirecciones hacia infraestructura previamente identificada como maliciosa, la presencia de técnicas de ofuscación y comportamientos de red asociados a seguimiento de sesión y huella digital del navegador.

El caso ilustra un escenario de IA contra IA: mientras el atacante utilizó modelos generativos para sofisticar la ofuscación del código, los sistemas defensivos detectaron patrones conductuales e indicadores contextuales que permitieron neutralizar la campaña a tiempo. La adopción ofensiva de IA no anuló las capacidades de detección: en ciertos aspectos, introdujo artefactos sintéticos que se convirtieron en nuevas señales explotables por los sistemas de defensa.

Este episodio demuestra que el aumento de sofisticación técnica impulsado por la inteligencia artificial no invalida la capacidad de los modelos defensivos para contener ataques generativos.[34]

Chuo Spring Co. implementó Darktrace como plataforma de Network Detection and Response con un enfoque distinto al de los sistemas perimetrales tradicionales. En lugar de operar sobre firmas o reglas predefinidas, la solución utiliza modelos de aprendizaje automático que construyen una línea base dinámica del comportamiento normal de usuarios, dispositivos y subredes.

El sistema se conecta directamente al switch central mediante port mirroring y analiza metadatos de tráfico como destino de paquetes, volumen, frecuencia y temporalidad de las comunicaciones. A partir de estos datos, la IA genera perfiles conductuales individuales y detecta desviaciones en tiempo real, ya sea por amenazas externas desconocidas o por actividad interna anómala.

Durante el período de evaluación, la plataforma identificó anomalías que, bajo las herramientas perimetrales previas, habrían quedado registradas únicamente como logs aislados, requiriendo análisis manual exhaustivo para comprender su naturaleza y alcance.

En contraste, Darktrace genera alertas de forma autónoma e inmediata ante cualquier desviación respecto a los patrones normales de comunicación, ejecutando además un proceso de triaje automatizado que prioriza los incidentes según su criticidad.

Este enfoque ha reducido de manera significativa el esfuerzo necesario para identificar comportamientos anómalos y determinar sus causas raíz, al tiempo que ha incrementado la confianza del equipo de seguridad en que los riesgos están siendo evaluados y contenidos de forma integral. Además, en modo de respuesta autónoma, la plataforma puede emitir paquetes de reset para interrumpir conexiones de alto riesgo las 24 horas del día, reduciendo la ventana de exposición ante posibles compromisos.

Complementariamente, el módulo Cyber AI Analyst incorpora años de decisiones humanas en materia de investigación de incidentes, capturando millones de patrones analíticos para replicar la lógica de trabajo de un especialista. Cuando se activa una alerta, el sistema ejecuta en segundos un proceso equivalente a un análisis experto, identifica relaciones causales entre eventos y genera informes estructurados en múltiples idiomas.

Esta automatización permitió a Chuo Spring mantener monitorización continua sin necesidad de construir un SOC interno ni externalizar la función, reduciendo costes operativos asociados a personal dedicado.

El caso evidencia cómo un modelo basado en aprendizaje conductual continuo permite detectar amenazas desconocidas, incluidos riesgos asociados a zero-days o ransomware, sin depender de firmas previas, integrando detección, triaje y contención en un mismo flujo operativo.[35]

En un entorno donde las amenazas operan a escala algorítmica y los modelos tradicionales resultan insuficientes, el despliegue de defensas basadas en inteligencia artificial deja de ser opcional. Sin embargo, esta transición no es meramente tecnológica: introduce nuevas capas de responsabilidad, riesgo sistémico y complejidad regulatoria que deben gestionarse de forma estructural.

La eficacia de la IA en ciberseguridad depende de su capacidad para procesar grandes volúmenes de datos: tráfico de red, comportamiento de usuarios, credenciales, inteligencia de amenazas y, en muchos casos, información personal sensible. Esta dependencia estructural de datos intensivos introduce tensiones directas entre seguridad y privacidad.

El tratamiento masivo de información exige marcos robustos de gobernanza de datos, basadas en principios de minimización, anonimización y control estricto de accesos. Garantizar la gestión, almacenamiento y protección segura de estos datos resulta esencial para prevenir brechas de privacidad y mitigar riesgos asociados a su uso indebido.[36]

Además de una obligación ética, existe una responsabilidad legal. En jurisdicciones como la Unión Europea, el incumplimiento de principios como minimización de datos, el consentimiento informado, el derecho de acceso o el derecho al olvido puede derivar en sanciones bajo el RGPD.[37]

El Reglamento Europeo de Inteligencia Artificial refuerza este marco al exigir transparencia cuando las personas interactúan con sistemas automatizados y al imponer obligaciones específicas en contextos de categorización biométrica o reconocimiento emocional.[38]

Los modelos aprenden de datos históricos. Si estos contienen sesgos, errores sistemáticos o representaciones incompletas, el sistema puede amplificarlos.

En ciberseguridad, esto puede traducirse en falsos positivos recurrentes sobre determinados perfiles de usuario o en la subestimación de amenazas provenientes de otros segmentos, afectando tanto la equidad como la eficacia operativa.

La mitigación de sesgos requiere procesos de validación continua, auditorías técnicas y diversidad en los datos de entrenamiento para asegurar la precisión y legitimidad del sistema.[39]

La naturaleza de “caja negra” de algunos modelos de inteligencia artificial plantea un dilema ético y operativo relevante. Muchos algoritmos avanzados, en particular los basados en aprendizaje profundo, presentan una lógica interna difícil de interpretar, y su programación suele ser inaccesible al tratarse de propiedad intelectual protegida. Esta opacidad limita la capacidad de comprender cómo y por qué el sistema llega a determinadas conclusiones, especialmente cuando se trata de decisiones inesperadas o de alto impacto.

En el ámbito de la ciberseguridad, esta falta de transparencia puede generar desconfianza e incertidumbre. Cuando un sistema automatizado señala una actividad como maliciosa, el profesional responsable debe poder explicar y justificar la decisión adoptada, ya sea ante comités internos, áreas legales, auditorías o reguladores. Si el modelo no ofrece una trazabilidad comprensible, la organización no solo enfrenta dificultades operativas, sino también riesgos de gobernanza y cumplimiento.

La exigencia de explicabilidad, por tanto, no responde únicamente a un criterio técnico de mejora del rendimiento del modelo, sino a la necesidad de garantizar rendición de cuentas, supervisión efectiva y coherencia con marcos regulatorios cada vez más estrictos.

La inteligencia artificial puede bloquear direcciones IP, suspender cuentas, aislar dispositivos o contener incidentes en cuestión de segundos, reduciendo de forma significativa la ventana de explotación. No obstante, cuando una decisión automatizada produce un error, la asignación de responsabilidad se vuelve difusa.

Si un sistema suspende un servicio crítico o bloquea una operación legítima, la pregunta no es únicamente técnica, sino organizacional: ¿la responsabilidad recae en el equipo que desplegó el sistema, en el proveedor tecnológico que diseñó el modelo o en la organización que delegó la decisión?

La automatización acelera la respuesta, pero también redistribuye el riesgo de decisión, obligando a redefinir marcos claros de supervisión humana, validación y accountability.[40]

La automatización de tareas rutinarias de detección y respuesta mediante inteligencia artificial puede disminuir la demanda de ciertos perfiles operativos tradicionales dentro de la función de ciberseguridad.

Este fenómeno trasciende la dimensión organizacional inmediata y adquiere implicaciones económicas y sociales más amplias. El desafío no reside únicamente en la posible sustitución de funciones, sino en la velocidad con la que deben reconvertirse competencias y redefinirse roles.

Las organizaciones deben anticipar esta transición mediante estrategias de recapacitación, actualización de habilidades y reasignación hacia funciones de mayor valor agregado, como supervisión estratégica, gobernanza de modelos y gestión avanzada de riesgos.

El dilema ético no es la automatización en sí misma, sino la gestión responsable de sus consecuencias sobre el talento y la empleabilidad.[41] La integración de inteligencia artificial en ciberseguridad no puede abordarse exclusivamente como una decisión tecnológica. Es una transformación estructural que redistribuye riesgos, responsabilidades y capacidades de decisión.

La resiliencia futura dependerá de la capacidad de las organizaciones para implementar IA con un enfoque integral: combinar automatización con supervisión humana efectiva, incorporar marcos regulatorios desde el diseño y evitar concentraciones excesivas de decisión en sistemas opacos.

En un entorno donde la competencia se produce entre capacidades algorítmicas, la ventaja no residirá únicamente en la potencia del modelo, sino en la solidez del marco ético, de gobernanza y de control que lo sostiene.

[1] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2025. Enero de 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://www.weforum.org/publications/global-cybersecurity-outlook-2025/digest/

[2] CHECK POINT. Cyber Security Report 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://www.checkpoint.com/security-report/

[3] STATISTA. Estimated cost of cybercrime worldwide 2018-2029. Febrero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://www.statista.com/forecasts/1280009/cost-cybercrime-worldwide/?srsltid=AfmBOopAay2joqDXn76O7WKNVbgsbI3KuPIenDq7jYpv0V9WkosqEuAY

[4] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Global_Cybersecurity_Outlook_2026.pdf

[5] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Global_Cybersecurity_Outlook_2026.pdf

[6] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Global_Cybersecurity_Outlook_2026.pdf

[7] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Global_Cybersecurity_Outlook_2026.pdf

[8] CHECK POINT. Cyber Security Report 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://www.checkpoint.com/security-report/

[9] IBM. What is data poisoning? [Consultado el 16 – 02 – 2026] Disponible en: https://www.ibm.com/think/topics/data-poisoning

[10] IBM. What is data poisoning? [Consultado el 16 – 02 – 2026] Disponible en: https://www.ibm.com/think/topics/data-poisoning

[11] IBM. What is a prompt injection attack? [Consultado el 16 – 02 – 2026] Disponible en: https://www.ibm.com/think/topics/prompt-injection

[12] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Global_Cybersecurity_Outlook_2026.pdf

[13] ASD. Social engineering. Mayo de 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://www.cyber.gov.au/threats/types-threats/social-engineering#:~:text=Social%20engineering%20techniques%20are%20used,sensitive%20information%20or%20transferring%20funds.

[14] MICROSOFT. Microsoft Digital Defense Report 2025. 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://cdn-dynmedia-1.microsoft.com/is/content/microsoftcorp/microsoft/msc/documents/presentations/CSR/Microsoft-Digital-Defense-Report-2025.pdf#page=1

[15] WORLD ECONOMIC FORUM. Artificial Intelligence and Cybersecurity: Balancing Risks and Rewards. Enero de 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Artificial_Intelligence_and_Cybersecurity_Balancing_Risks_and_Rewards_2025.pdf

[16] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2025. Enero de 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://www.weforum.org/publications/global-cybersecurity-outlook-2025/digest/

[17] KASPERSKY. What is Social Engineering? [Consultado el 16 – 02 – 2026] Disponible en: https://www.kaspersky.com/resource-center/definitions/what-is-social-engineering

[18] CHECK POINT. How AI Phishing Attacks Became A Threat in 2025. 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://www.checkpoint.com/cyber-hub/threat-prevention/what-is-phishing/ai-phishing-attacks/

[19] ENISA. ENISA Threat Landscape 2025. Octubre de 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://www.enisa.europa.eu/sites/default/files/2026-01/ENISA%20Threat%20Landscape%202025_v1.2.pdf

[20] CHECK POINT. How AI Phishing Attacks Became A Threat in 2025. 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://www.checkpoint.com/cyber-hub/threat-prevention/what-is-phishing/ai-phishing-attacks/

[21] MICROSOFT. Microsoft Digital Defense Report 2025. 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://cdn-dynmedia-1.microsoft.com/is/content/microsoftcorp/microsoft/msc/documents/presentations/CSR/Microsoft-Digital-Defense-Report-2025.pdf#page=1

[22] CYMULATE. Cybersecurity Reconnaissance. [Consultado el 16 – 02 – 2026] Disponible en: https://cymulate.com/cybersecurity-glossary/cyber-reconnaissance/

[23] WORLD ECONOMIC FORUM. Artificial Intelligence and Cybersecurity: Balancing Risks and Rewards. Enero de 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Artificial_Intelligence_and_Cybersecurity_Balancing_Risks_and_Rewards_2025.pdf

[24] FORTINET. AI in Cybersecurity: Key Benefits, Defense Strategies, & Future Trends. 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://www.fortinet.com/uk/resources/cyberglossary/artificial-intelligence-in-cybersecurity#:~:text=AI%20empowers%20cybersecurity%20systems%20to,defense%20and%20safeguarding%20sensitive%20data.

[25] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Global_Cybersecurity_Outlook_2026.pdf

[26] PALO ALTO. What Is the Role of AI in Threat Detection? [Consultado el 16 – 02 – 2026] Disponible en: https://www.paloaltonetworks.com/cyberpedia/ai-in-threat-detection

[27] MICROSOFT. Microsoft Digital Defense Report 2025. 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://cdn-dynmedia-1.microsoft.com/is/content/microsoftcorp/microsoft/msc/documents/presentations/CSR/Microsoft-Digital-Defense-Report-2025.pdf#page=1

[28] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2025. Enero de 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://www.weforum.org/publications/global-cybersecurity-outlook-2025/digest/

[29] PALO ALTO. What Is the Role of AI in Security Automation? [Consultado el 16 – 02 – 2026] Disponible en: https://www.paloaltonetworks.com/cyberpedia/role-of-artificial-intelligence-ai-in-security-automation

[30] STATISTA. Value of the artificial intelligence (AI) cybersecurity market worldwide from 2023 to 2030. Enero de 2026. Consultado el 16 – 02 – 2026] Disponible en: https://www.statista.com/statistics/1450963/global-ai-cybersecurity-market-size/

[31] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Global_Cybersecurity_Outlook_2026.pdf

[32] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Global_Cybersecurity_Outlook_2026.pdf

[33] WORLD ECONOMIC FORUM. Global Cybersecurity Outlook 2026. Enero de 2026. [Consultado el 16 – 02 – 2026] Disponible en: https://reports.weforum.org/docs/WEF_Global_Cybersecurity_Outlook_2026.pdf

[34] MICROSOFT. AI vs. AI: Detecting an AI-obfuscated phishing campaign. Septiembre de 2025. [Consultado el 16 – 02 – 2026] Disponible en: https://www.microsoft.com/en-us/security/blog/2025/09/24/ai-vs-ai-detecting-an-ai-obfuscated-phishing-campaign/

[35] DARKTRACE. Chuo Springs Co. [Consultado el 16 – 02 – 2026] Disponible en: https://www.darktrace.com/customers/chuo-springs-co

[36] PALO ALTO. What are the Risks and Benefits of Artificial Intelligence (AI) in Cybersecurity? [Consultado el 16 – 02 – 2026] Disponible en: https://www.paloaltonetworks.com/cyberpedia/ai-risks-and-benefits-in-cybersecurity

[37] VIPRE. Ethical Considerations in AI-Powered Cybersecurity. Noviembre de 2024. [Consultado el 16 – 02 – 2026] Disponible en: https://vipre.com/blog/ethical-considerations-ai-powered-cybersecurity/?srsltid=AfmBOorOL55kwRyKfQwcztahvwFRp9SlS4piGeoCmyli31RtUJioXReN

[38] VIPRE. Ethical Considerations in AI-Powered Cybersecurity. Noviembre de 2024. [Consultado el 16 – 02 – 2026] Disponible en: https://vipre.com/blog/ethical-considerations-ai-powered-cybersecurity/?srsltid=AfmBOorOL55kwRyKfQwcztahvwFRp9SlS4piGeoCmyli31RtUJioXReN

[39] PALO ALTO. What are the Risks and Benefits of Artificial Intelligence (AI) in Cybersecurity? [Consultado el 16 – 02 – 2026] Disponible en: https://www.paloaltonetworks.com/cyberpedia/ai-risks-and-benefits-in-cybersecurity

[40] ISC2. The Ethical Dilemmas of AI in Cybersecurity. Enero de 2024. ? [Consultado el 16 – 02 – 2026] Disponible en: https://www.isc2.org/Insights/2024/01/The-Ethical-Dilemmas-of-AI-in-Cybersecurity

[41] ISC2. The Ethical Dilemmas of AI in Cybersecurity. Enero de 2024. ? [Consultado el 16 – 02 – 2026] Disponible en: https://www.isc2.org/Insights/2024/01/The-Ethical-Dilemmas-of-AI-in-Cybersecurity