España se queda sin talento en IA: el 80% de las empresas no encuentra profesionales

La demanda de perfiles técnicos crece un 34%, pero la falta de profesionales cualificados ralentiza proyectos y dispara los salarios tecnológicos

Copilot se ha convertido en una herramienta clave para resolver dudas de salud, entender informes y ofrecer apoyo emocional. Esto conlleva beneficios, pero también riesgos, para la ciudadanía

Más allá de las búsquedas tradicionales en internet, millones de personas recurren cada día a sistemas como Copilot para resolver dudas relacionadas con síntomas, tratamientos, hábitos de bienestar o preparación de consultas médicas. Según Microsoft, este tipo de preguntas se encuentra entre las más frecuentes en su asistente de IA.

Este fenómeno abre un debate social de fondo: ¿puede la IA democratizar el acceso a la información sanitaria sin poner en riesgo la seguridad de las personas? Organismos como la Organización Mundial de la Salud (OMS) recuerdan que estas tecnologías pueden ser útiles, pero también peligrosas si se despliegan sin supervisión adecuada. La cuestión ya no es si la ciudadanía usa IA para temas de salud -porque ya lo hace-, sino cómo garantizar que ese uso sea responsable, seguro y equitativo.

En su informe AI and Health: How people are using Copilot for health, Microsoft reconoce que una parte muy significativa de las consultas diarias al asistente está relacionada con el bienestar físico y mental. No se trata de un fenómeno marginal: son millones de preguntas al día. Y el perfil del usuario es diverso: cuidadores, padres primerizos, pacientes crónicos, jóvenes que buscan información rápida y personas mayores acompañadas por familiares. Copilot se ha convertido en una especie de enfermera digital disponible 24/7, capaz de traducir información médica compleja a un lenguaje accesible.

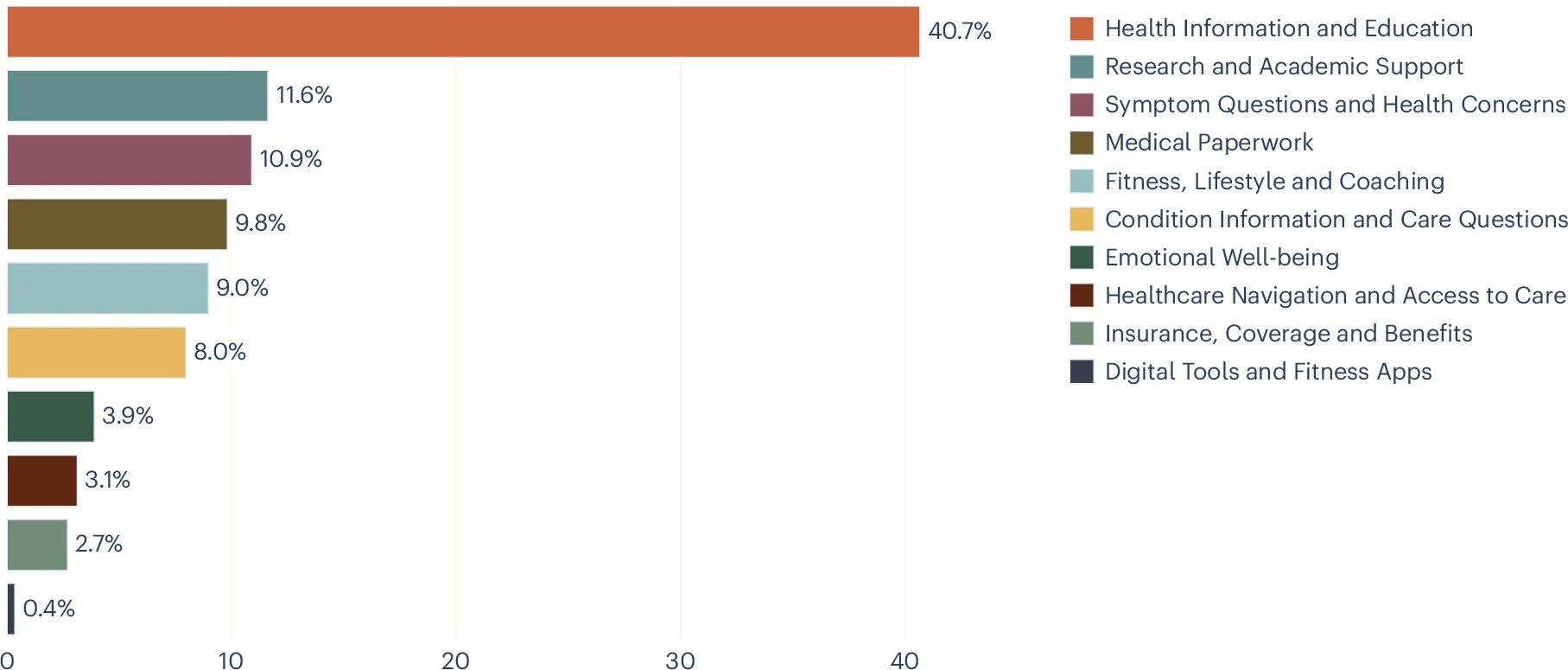

¿Para qué se usa? Según Microsoft y estudios publicados en JAMA y Nature Medicine, las consultas se concentran en cuatro grandes bloques:

Estas funciones no sustituyen a un profesional sanitario, pero sí ayudan a las personas a llegar mejor preparadas a la consulta, entender sus informes o reducir la incertidumbre inicial.

Pero la IA no solo acompaña al paciente en casa: también empieza a integrarse en entornos clínicos. Microsoft colabora con Epic Systems, líder en historia clínica electrónica, y con Paige.AI, especializada en diagnóstico por imagen, para incorporar Copilot en flujos de trabajo médicos. La OMS, en su guía de 2024 sobre IA multimodal en salud, advierte que estas herramientas pueden mejorar la eficiencia, pero requieren auditorías, transparencia y supervisión humana constante.