IA para romper barreras

Más allá del código, la IA ha encontrado su propósito más humano. Adéntrate en un análisis sobre cómo la innovación está devolviendo el control, la…

Planear, recordar o analizar solía exigir atención, tiempo y esfuerzo intelectual. Hoy, la inteligencia artificial ejecuta esas funciones en segundos. Pero esta facilidad tiene un precio, a medida que externalizamos memoria, criterio y juicio, empieza a emerger una nueva forma de deuda: la que acumulamos cuando dejamos que la tecnología piense por nosotros.

La inteligencia artificial (IA) se ha convertido en una presencia estructural en nuestras vidas. En apenas unos años, ha pasado de ser una herramienta especializada a una tecnología cotidiana que permea nuestras rutinas personales, laborales y educativas.

Hoy, la IA no solo está en los grandes sistemas corporativos, se encuentra en los hogares, en los móviles, en las aulas y en las conversaciones diarias. Su alcance es tan amplio que, de una u otra forma, millones de personas interactúan con ella cada día, a menudo sin ser plenamente conscientes de ello.

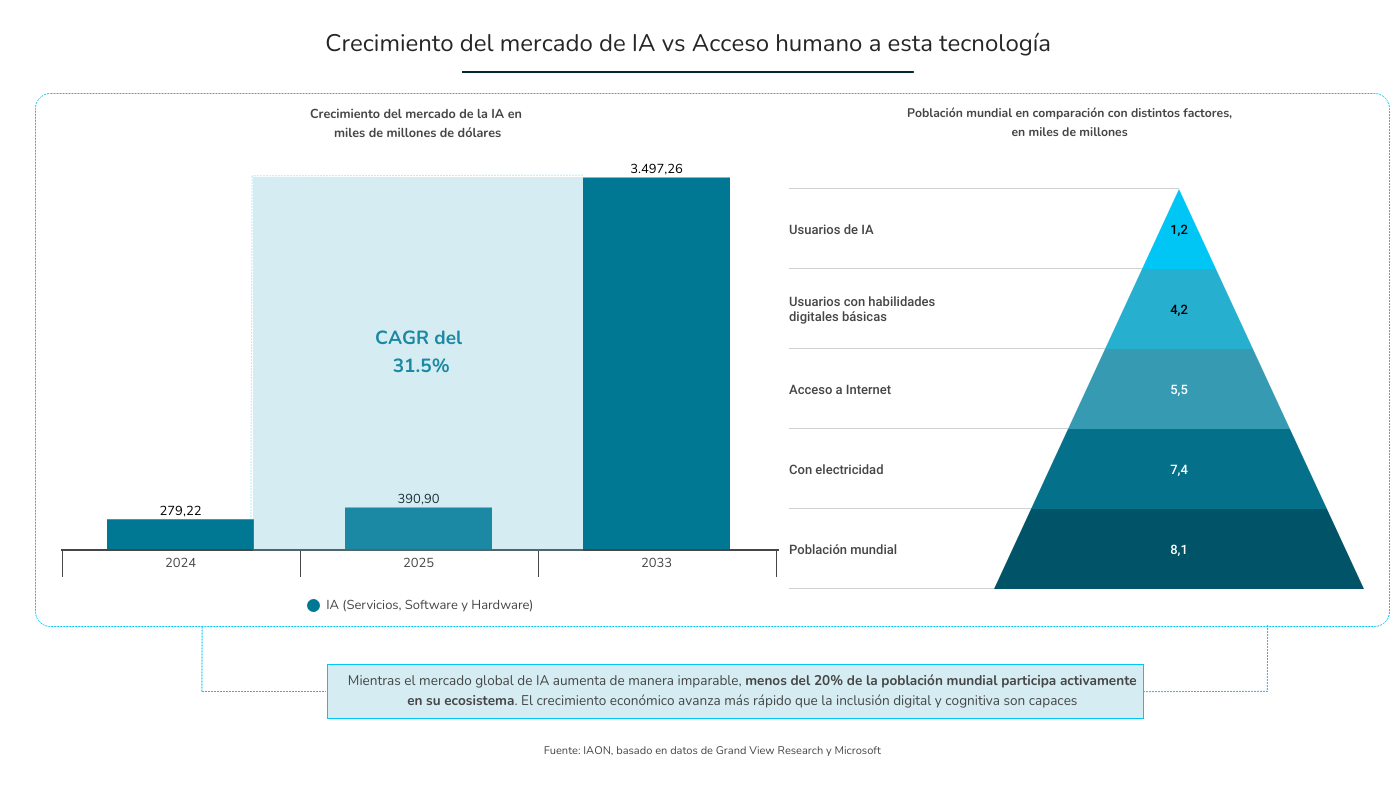

El peso económico de este fenómeno es tan contundente como su penetración social. El mercado global de IA alcanzó los 279.220 millones de dólares en 2024 y se prevé que escale hasta los 3,5 billones en 2033, con una tasa de crecimiento anual del 31,5% entre 2025 y 2033.

Este ritmo de expansión sitúa a la IA entre las tecnologías de adopción más acelerada de la historia reciente, impulsada por la inversión masiva y la investigación constante de gigantes tecnológicos que aplican estos sistemas en sectores como automoción, salud, finanzas, retail y manufactura [1].

Pero las cifras macroeconómicas solo cuentan una parte de la historia. La adopción individual muestra una transformación aún más profunda, en 2025, las herramientas de IA alcanzaron a 378 millones de usuarios en todo el mundo, lo que representa el mayor salto interanual registrado; unos 64 millones de nuevos usuarios en solo un año.

En perspectiva, el número actual de usuarios es más del triple que los 116 millones contabilizados hace apenas cinco años. Pese a ello, solo el 3% paga por servicios premium, lo que sugiere un mercado de consumo con enorme potencial aún por explotar[2].

El uso doméstico de la inteligencia artificial se ha normalizado a una velocidad sorprendente. Hoy, uno de cada tres usuarios (32,6%) emplea la IA dentro del hogar para tareas cotidianas como buscar información, resolver dudas, recibir consejos personalizados o asistir en la redacción de textos.

De hecho, más del 70% de las interacciones con ChatGPT son no laborales,[3] lo que confirma que la adopción no responde solo a necesidades de productividad, sino a una integración profunda en las dinámicas personales: desde gestionar tareas domésticas hasta estructurar pensamientos, explorar ideas o tomar decisiones rápidas.

Asistentes virtuales como Alexa o Siri gestionan recordatorios, alarmas, listas y búsquedas, los sistemas domóticos anticipan preferencias y automatizan tareas domésticas[4] y los dispositivos wearables y aplicaciones de salud monitorizan constantes vitales, sueño y actividad física para ofrecer recomendaciones personalizadas.

A ello se suma una creciente externalización de funciones básicas como la navegación, recordatorios, organización del hogar, e incluso vigilancia del bienestar físico y emocional. La IA se convierte así en primer punto de contacto para dudas, decisiones rápidas y micro tareas cognitivas.

En el ámbito empresarial, la expansión es incluso más acelerada. En solo un año, la proporción de organizaciones que utilizan IA en al menos una función de negocio pasó del 55% al 78%, reflejando uno de los mayores incrementos de adopción tecnológica de las últimas décadas.

El uso de IA generativa se duplicó, pasando del 33% en 2023 al 71% en 2024, impulsado por resultados tangibles, las empresas reportan un retorno promedio de 3,7 veces por cada dólar invertido en estas tecnologías[2].

Los trabajadores utilizan estas herramientas para automatizar tareas repetitivas como gestión de calendarios, entrada de datos o elaboración de reportes e informes, liberando un promedio de 3,5 horas semanales que pueden redirigirse a trabajo estratégico, análisis o creatividad[5].

En paralelo, los equipos directivos emplean la IA para escenarios de planificación, análisis de riesgos y supervisión de la gobernanza tecnológica, integrándola como parte de la toma de decisiones de alto nivel y de la gestión de crecimiento.[6]

El sector educativo tampoco queda al margen. Aproximadamente el 43% de los estudiantes universitarios utiliza herramientas basadas en IA para personalizar su aprendizaje, mejorar sus resultados o automatizar tareas como la corrección o la organización del estudio.

Entre los adolescentes, el uso también se ha disparado, uno de cada cuatro jóvenes (26%) empleó ChatGPT para tareas escolares en 2024, el doble que en 2023. Y, entre los universitarios, la mitad reconoce usar IA para mejorar la calidad de su trabajo académico. Los docentes, por su parte, empiezan a apoyarse en ella para reducir carga administrativa y enfocar su tiempo en tareas pedagógicas de mayor valor añadido[7].

Es observable, por lo tanto, que el uso y adopción de la inteligencia artificial viene justificado por la cantidad de soluciones y servicios que nos ofrece de manera rápida y personalizada a mano y capacidad real para resolver fricciones profundas de la vida moderna.

La IA responde a tres grandes demandas universales: rapidez, eficiencia y optimización de recursos. En un entorno donde el tiempo es un activo escaso y la complejidad informativa aumenta de manera exponencial, estas herramientas permiten automatizar tareas tediosas, reducir costes operativos y simplificar procesos que antes requerían horas de esfuerzo y atención.

Cada vez que la utilizamos y nos entrega una solución inmediata, refuerza la idea de que es más eficiente delegar que pensar. Esa lógica económica y práctica impulsa la dependencia.

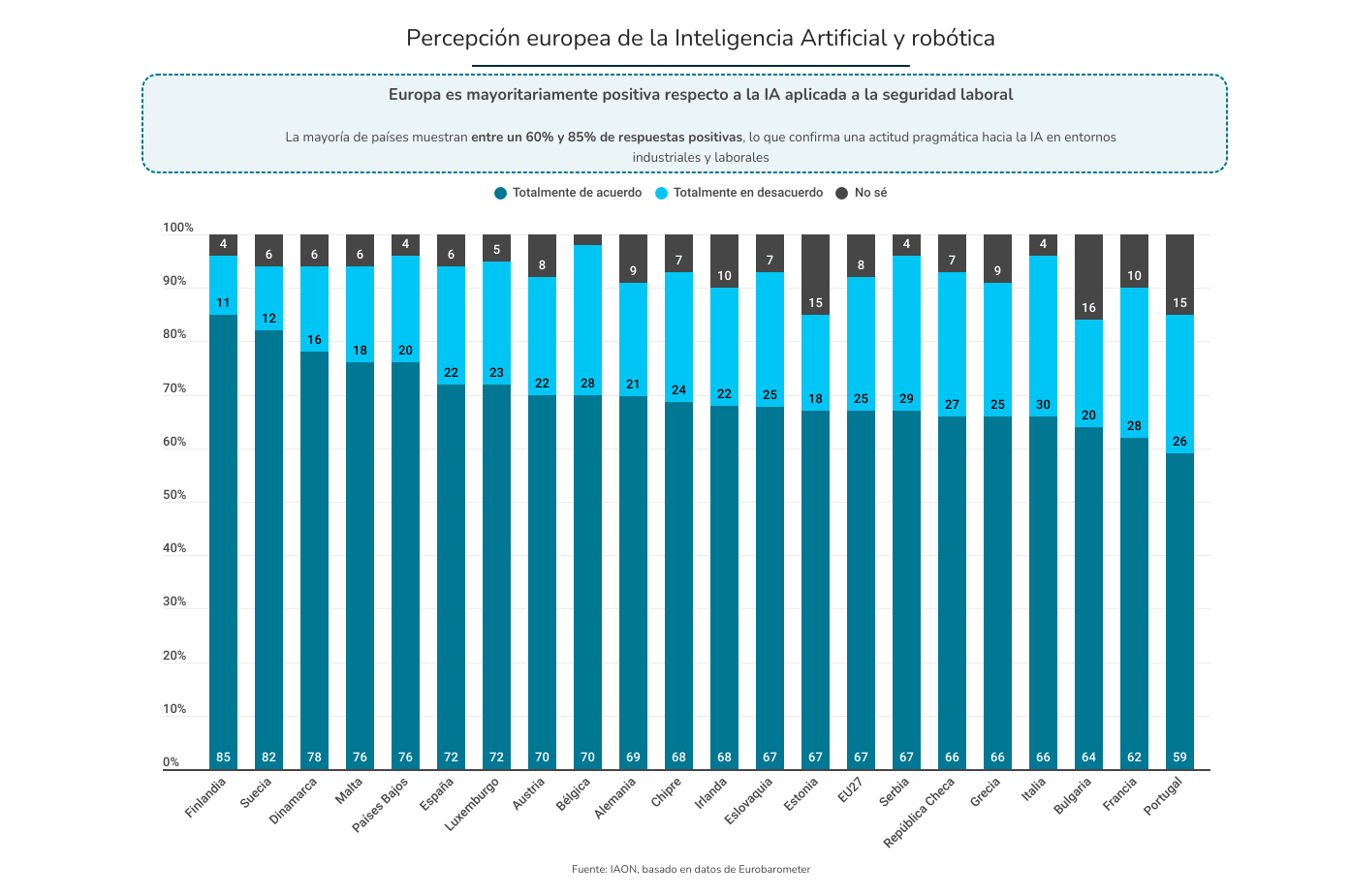

Pese a esta expansión masiva, la sociedad no adopta la IA sin reservas. Según el Eurobarómetro (2025), aunque el 67% de los europeos ve con buenos ojos el desarrollo de la inteligencia artificial y la robótica, el 84% cree que su uso requiere una gestión cuidadosa.

Las preocupaciones se centran, sobre todo, en su impacto social y laboral. La automatización promete aliviar el trabajo repetitivo y mejorar la precisión en la toma de decisiones, pero muchos temen que degrade la comunicación entre colegas, reduzca la autonomía profesional o invada la privacidad.

Por ello, el 82% de los ciudadanos europeos apoya la creación de reglas claras que protejan la intimidad de los trabajadores y el 77% defiende que estos mismos participen activamente en el diseño y adopción de las nuevas tecnologías[8].

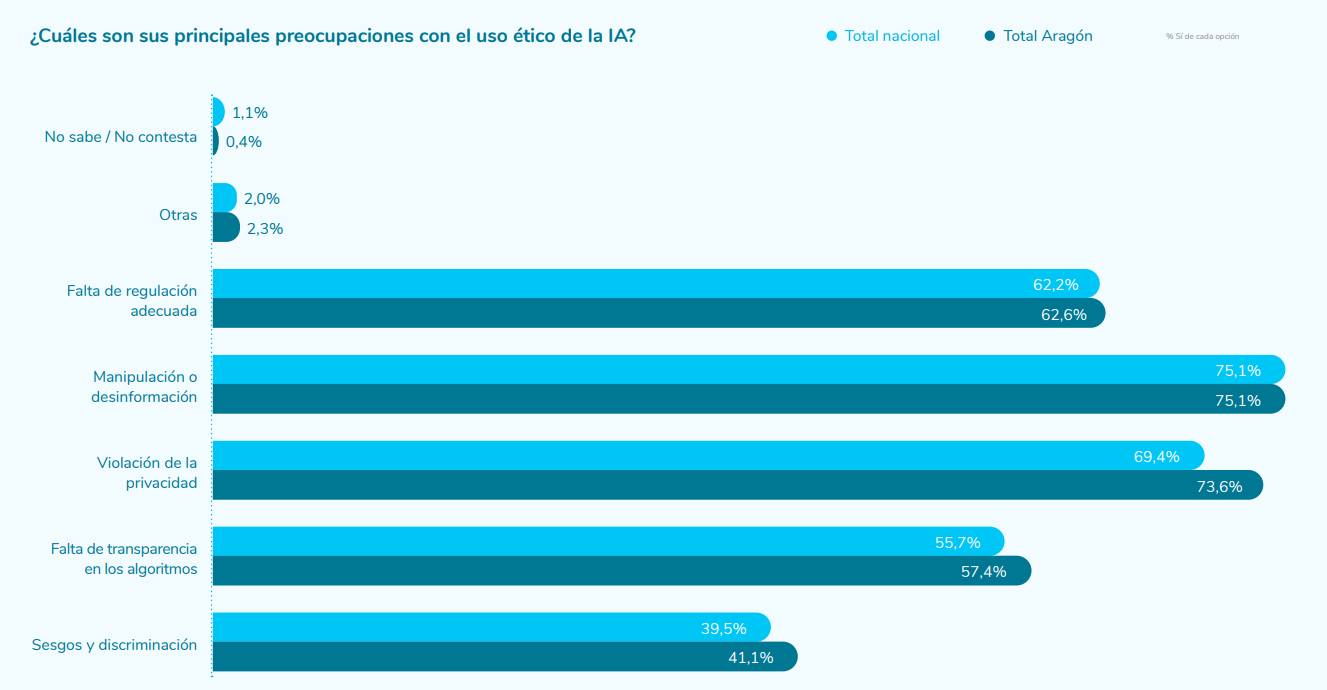

Según se pudo observar en nuestro Observatorio Anual publicado en julio, España comparte con el resto de Europa una sensación ambivalente frente al avance de la inteligencia artificial. A medida que esta tecnología se integra en más ámbitos de la vida, crece también la inquietud por su impacto ético, social y cognitivo.

La privacidad encabeza las alertas más extendidas. Más de dos tercios de los encuestados teme un uso inadecuado de sus datos personales, una percepción especialmente intensa entre mujeres y personas mayores de 43 años.

Por otro lado, el 75,1% de los españoles considera que la capacidad de la IA para generar o amplificar contenidos falsos representa una amenaza real. La IA, al multiplicar la velocidad y el alcance de la desinformación, obliga a replantear el equilibrio entre libertad de expresión, veracidad y responsabilidad digital.

Fuente: Observatorio Anual IAON

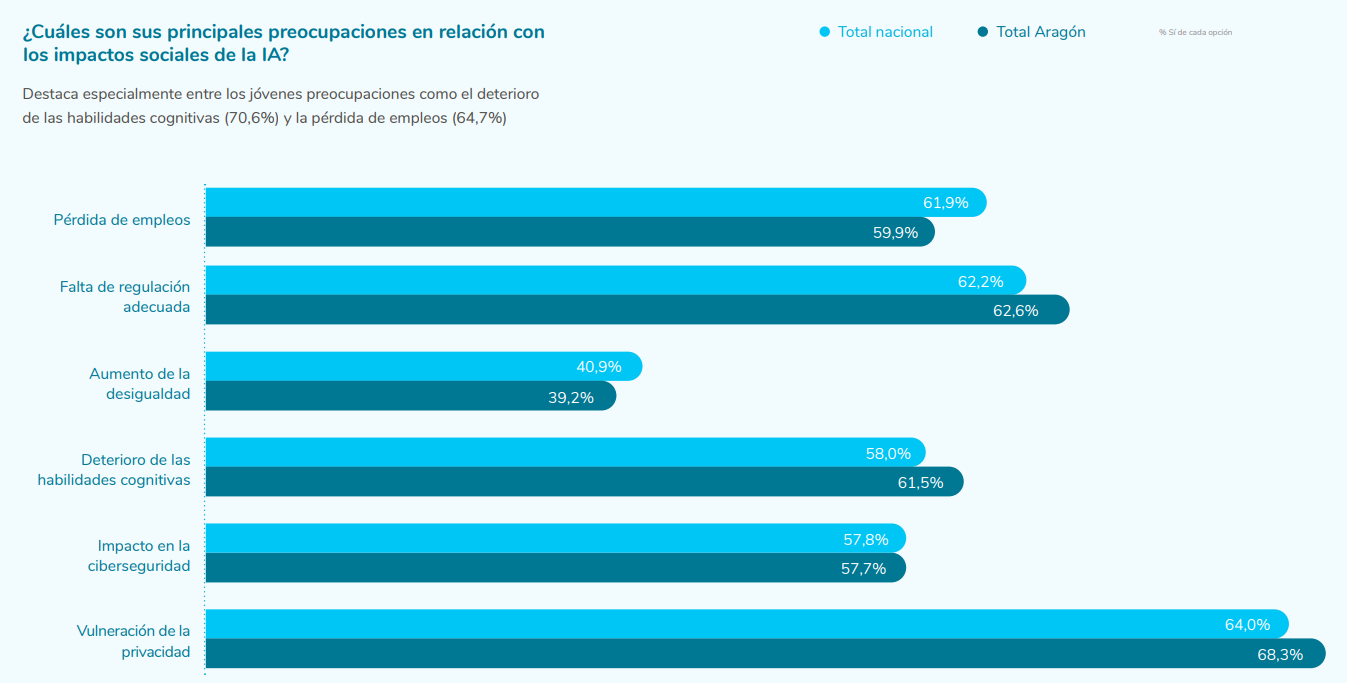

Pero las preocupaciones de la población española trascienden la esfera informativa. En los sectores más jóvenes de la población, emergen con fuerza las alertas sobre el deterioro de las habilidades cognitivas (70,6%) y la pérdida de empleos (64,7%).

Estos datos reflejan una intuición colectiva sobre que el progreso tecnológico no es neutral y que, sin gestión adecuada, puede profundizar desigualdades y transformar de manera irreversible la forma en que pensamos, trabajamos y aprendemos.

El 61,9% de los españoles teme que la automatización impulsada por la IA desplace a amplios sectores del mercado laboral, especialmente los perfiles medios, generando una presión creciente sobre las competencias digitales.

Este temor se combina con la falta de una regulación clara, que inquieta al 62,2% de los encuestados. En conjunto, la vulneración de la privacidad (64%), la falsa información y el impacto en el empleo conforman el núcleo de las inquietudes nacionales.

Sin embargo, una de las preocupaciones más interesantes y menos exploradas es la que apunta al deterioro de las capacidades cognitivas y la dependencia tecnológica, citada por casi seis de cada diez españoles (58%). La facilidad con la que la IA resuelve tareas cotidianas genera el temor a una externalización excesiva del pensamiento crítico, la memoria y el razonamiento.

Se empieza a hablar de una posible pereza intelectual, una tendencia a delegar en la máquina la reflexión profunda, la comparación de ideas o la resolución de problemas complejos[9]. Esta percepción abre una nueva dimensión del debate público, más allá de la privacidad o el empleo, la preocupación gira en torno a qué tipo de seres humanos estamos formando en una sociedad asistida por algoritmos.

En otras palabras, la atención se desplaza de lo que la tecnología puede hacer por nosotros hacia lo que nosotros dejamos de hacer cuando ella lo hace todo.

Fuente: Observatorio Anual IAON

Detrás de las preocupaciones por la pérdida de habilidades cognitivas, se esconde un fenómeno más profundo, ya identificado por la comunidad científica: la deuda cognitiva. Este concepto describe el coste invisible que asume la mente humana cuando transfiere parte de su esfuerzo intelectual a sistemas automatizados.

De forma análoga a la deuda técnica en informática, la noción sugiere que delegar en la máquina un proceso de pensamiento que antes hacíamos nosotros puede acumular una “deuda” a largo plazo en nuestras propias capacidades mentales.

En esencia, la deuda cognitiva surge del uso del “cognitive offloading” o descarga cognitiva, un término que hace referencia a la tendencia a delegar tareas mentales (como recordar, analizar o decidir) a herramientas externas.

Esta práctica no es nueva, la humanidad lleva siglos descargando su memoria en libros, calendarios o calculadoras. Lo disruptivo hoy es la escala y la velocidad con que esta externalización ocurre gracias a la inteligencia artificial, que ya no solo almacena o calcula, sino que piensa, recomienda y decide[10].

Diversos estudios señalan que el uso intensivo de estas tecnologías está asociado a una disminución en las capacidades de pensamiento crítico, especialmente entre los más jóvenes, grupo con el mayor hábito de uso de IA en su vida personal y académica.

Este fenómeno no implica una pérdida inmediata de inteligencia, pero si una reconfiguración de la función cognitiva, donde el cerebro humano prioriza saber dónde encontrar la información antes que recordarla o analizarla por sí mismo.

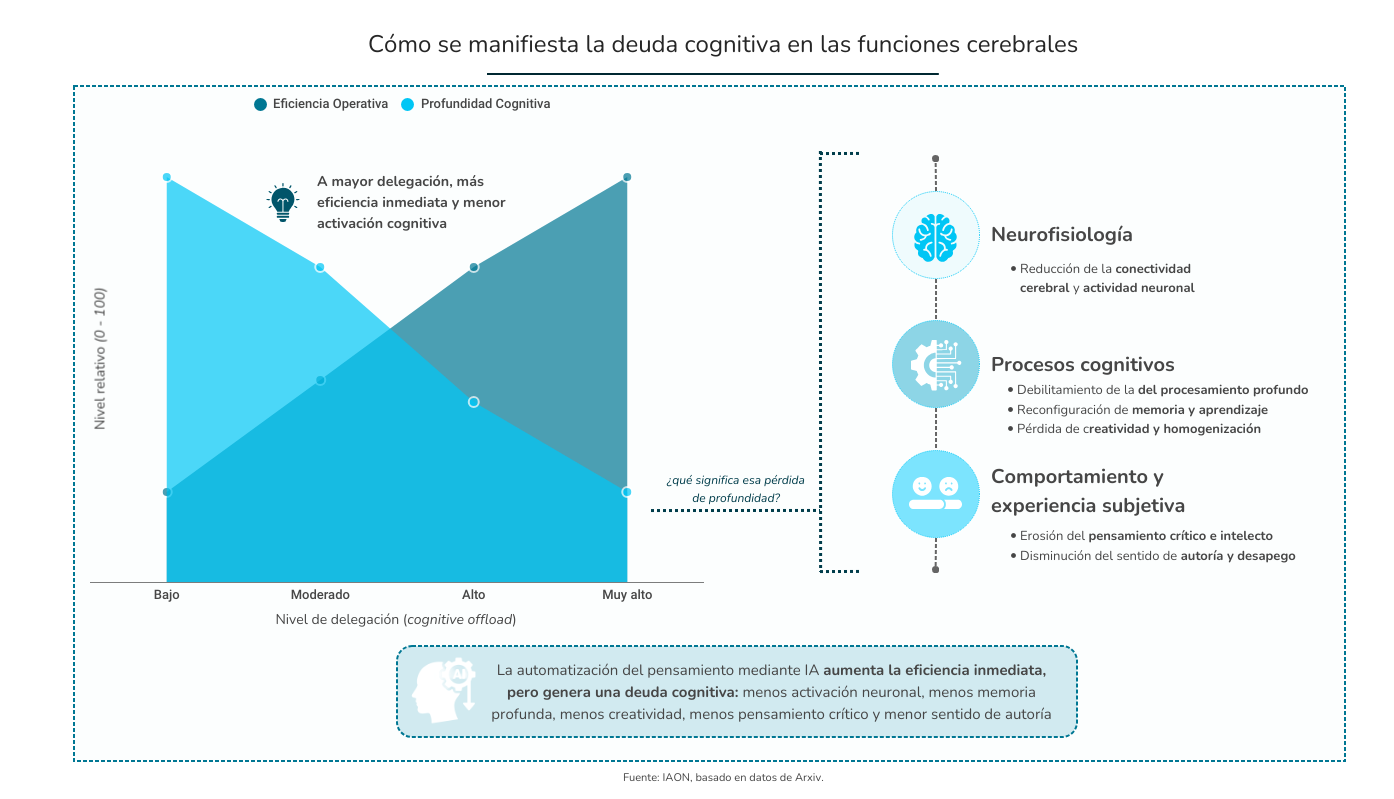

No hay duda de que la IA amplía las capacidades humanas, permitiendo analizar grandes volúmenes de datos o detectar patrones invisibles al ojo humano. Pero esa ventaja tiene un inconveniente, la delegación excesiva puede debilitar la capacidad de análisis profundo y el razonamiento independiente.

En paralelo, los sistemas de recomendación y verificación automatizada, diseñados para filtrar información de baja calidad, pueden reducir la diversidad cognitiva al reforzar nuestros sesgos. Este fenómeno, conocido como sesgo algorítmico, crea burbujas de información que confirman lo que ya creemos, limitando la exposición a ideas opuestas y erosionando la evaluación crítica.

A corto plazo, delegar ciertas funciones como la memoria, la toma de decisiones o la resolución de problemas en sistemas inteligentes puede parecer beneficioso: libera recursos mentales y permite concentrarse en tareas más creativas o complejas. Pero, cuando esta práctica se vuelve habitual, el beneficio se transforma en dependencia, reduciendo nuestra capacidad de atención, razonamiento y memoria autónoma.

Esta misma dependencia nos lleva a la pereza cognitiva (“cognitive laziness”), es decir, cuanto más se automatiza el pensamiento, menos nos sentimos inclinados a pensar profundamente.

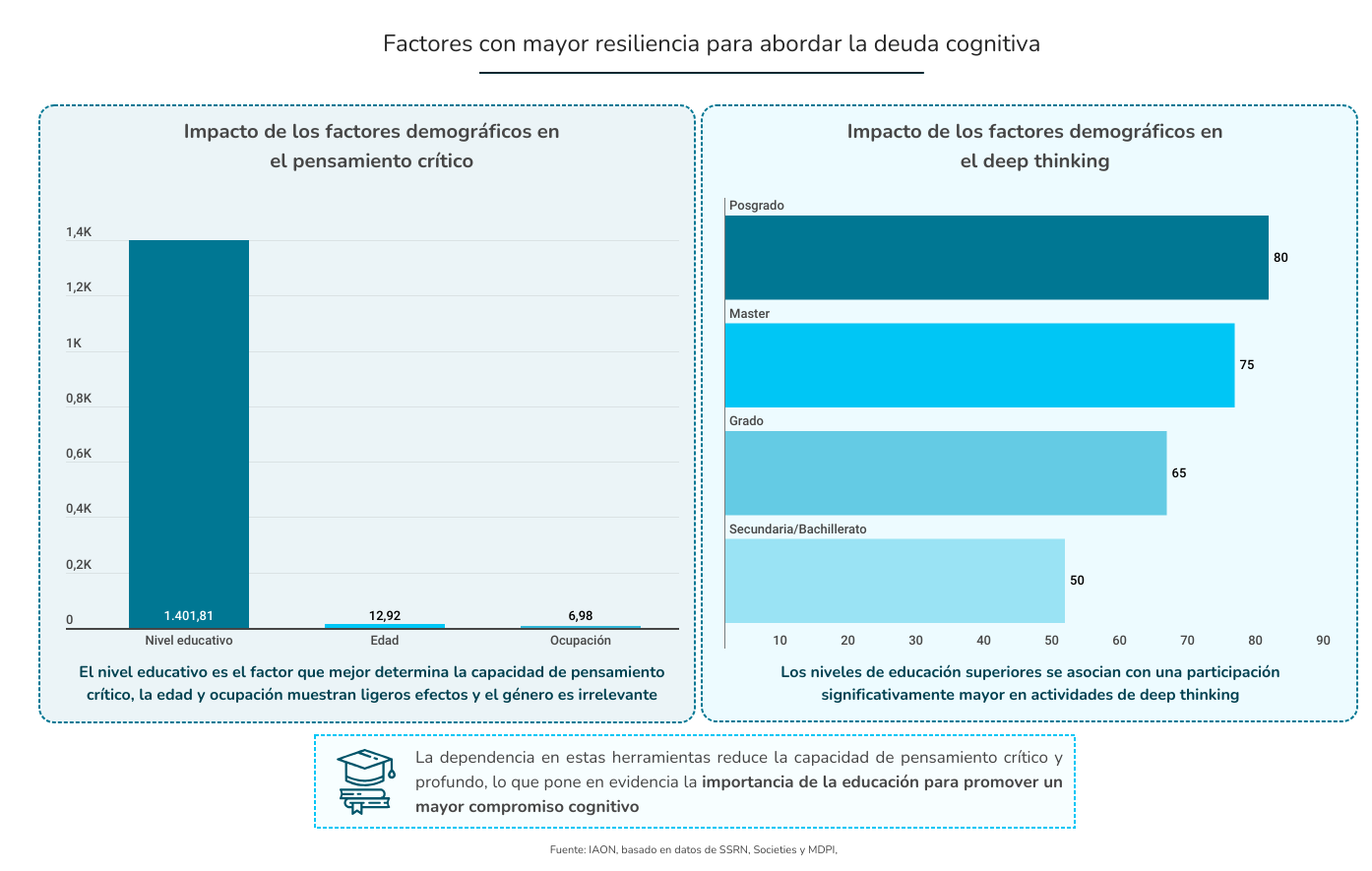

Las evidencias confirman el patrón, en estudios recientes, los participantes jóvenes (entre 17 y 25 años), los cuales comparten un mayor uso de herramientas de IA y más altos niveles de cognitive offloading, registraron menores puntuaciones en pensamiento crítico.

En contraste, los grupos mayores (de 46 años en adelante), menos dependientes de la tecnología, mostraron mayor capacidad analítica y de pensamiento profundo. Las diferencias se amplifican con la educación: los niveles más altos de formación correlacionan con mayor resistencia al pensamiento automatizado y mayor compromiso con la reflexión independiente.

En conjunto, la evidencia sugiere que la deuda cognitiva no afecta a todos por igual, sino que amplifica las diferencias existentes entre generaciones y niveles de alfabetización digital. La educación es el principal amortiguador frente a los efectos adversos del uso intensivo de la IA, por lo que, queda clara la necesidad de intervenciones educativas que fomenten una relación más crítica y consciente con la tecnología[11].

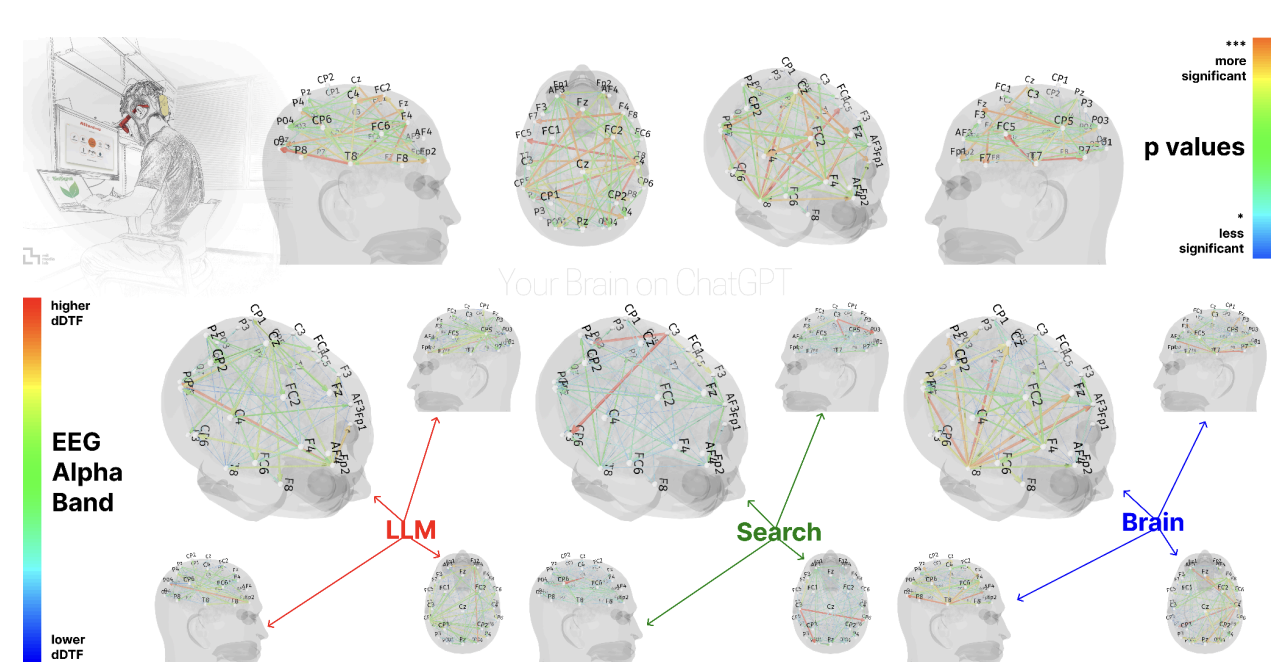

Los hallazgos más recientes sobre el impacto del uso intensivo de la inteligencia artificial muestran con claridad que la llamada deuda cognitiva no es una abstracción teórica, sino un fenómeno observable[12].

Fuente: MIT Media Lab

La evidencia sugiere que el cerebro humano está empezando a reconfigurarse frente a la automatización del pensamiento, generando cambios medibles en su funcionamiento y en la manera en que procesamos, recordamos y nos relacionamos con el conocimiento:

Estas manifestaciones confluyen en un patrón, el de un cerebro que prioriza la inmediatez sobre la profundidad. Cuanto más se delega el esfuerzo mental, menos se activan las redes neuronales implicadas en la atención, la memoria y la reflexión. El resultado es una inteligencia más eficiente en tareas operativas, pero menos resiliente, autónoma y creativa. La eficiencia instantánea sustituye al esfuerzo sostenido, y con ello, el cerebro ajusta su modo de operar[13][14].

La IA puede impulsarnos hacia un conocimiento más vasto y preciso, pero también puede empujarnos hacia una comprensión más superficial y dependiente, debilitando la capacidad de profundizar, razonar críticamente o generar ideas propias.

Esta deuda cognitiva no se limita a un deterioro de las habilidades mentales individuales, cuando la externalización del pensamiento se convierte en hábito colectivo, lo que está en juego es la calidad del pensamiento social, la distribución del conocimiento y la autonomía intelectual de las sociedades.

El uso masivo de la IA tiende a reducir la diversidad cognitiva, generando entornos donde proliferan ideas repetidas y visiones uniformes. Esta homogeneización facilita la polarización digital, ya que los algoritmos refuerzan sesgos y alimentan cámaras de eco que limitan la exposición a perspectivas divergentes.

A medida que más personas aceptan sin cuestionar las sugerencias algorítmicas, se erosiona el criterio ciudadano y se debilita la deliberación pública. Las sociedades que delegan el pensamiento crítico son más vulnerables a la desinformación, menos capaces de sostener debates de calidad y menos propensas a la participación.

Esta tendencia se agrava con la aparición de brechas cognitivas[15]. No todos los grupos sociales poseen las mismas competencias para usar la IA de forma crítica y la población con menor alfabetización digital depende más de las recomendaciones algorítmicas, perdiendo autonomía mental y ampliando desigualdades en la capacidad de analizar, decidir y representar sus intereses[16].

A nivel cultural, esta externalización masiva del pensamiento favorece la delegación de la autoridad intelectual. Si las respuestas rápidas sustituyen al análisis experto, la sociedad evoluciona hacia un modelo de consumo cognitivo donde el contenido se absorbe, pero no se genera[17].

En el ámbito económico, afecta directamente a la capacidad creativa y estratégica de individuos y organizaciones. La tendencia a recurrir a ideas “ready to use” puede atrofiar la creatividad humana y reducir la generación de soluciones originales.

Las empresas que caen en esta lógica entran en lo que se llama “trampa Turing”, priorizando máquinas que imitan al humano en lugar de herramientas que potencian al talento. Esto erosiona la diferenciación competitiva y desplaza inversión desde la innovación auténtica hacia una automatización que produce resultados correctos, pero poco disruptivos.

A nivel macro, estos efectos derivan en nuevas desigualdades estructurales. Los países y empresas con mayor alfabetización cognitiva y capacidad crítica aprovecharán la IA como una palanca de crecimiento. En cambio, aquellos que la utilicen como sustituto del pensamiento humano verán debilitada su resiliencia competitiva, ampliando la brecha económica global[18].

A medida que las personas delegan qué y cómo pensar en la IA, se compromete la autonomía mental. La manipulación algorítmica de sesgos, la personalización extrema y la desinformación amplificada erosionan la capacidad de las personas para formarse juicios propios, afectando directamente a la calidad de la democracia.

Además, la dependencia cognitiva favorece la centralización del poder intelectual en manos de quienes controlan los modelos, los datos y las plataformas digitales. Esto, en la práctica, puede fortalecer estructuras donde una minoría produce conocimiento estructural mientras la mayoría actúa como consumidora pasiva.

Finalmente, la pérdida de autoría cognitiva diluye el sentido de agencia individual, si las ideas no se generan, sino que se supervisan, disminuye la capacidad de decidir, innovar y deliberar. El poder de pensar, y por tanto de influencia, pasa de las personas a las herramientas, configurando un escenario donde la subordinación intelectual se convierte en un riesgo real[19].

En conjunto, estos procesos apuntan a una amenaza más profunda; la pérdida de soberanía cognitiva, tanto individual como colectiva. Si las sociedades dejan de cultivar su propio pensamiento crítico y delegan su capacidad de análisis en sistemas privados, corren el riesgo de depender estructuralmente de herramientas que no controlan ni comprenden.

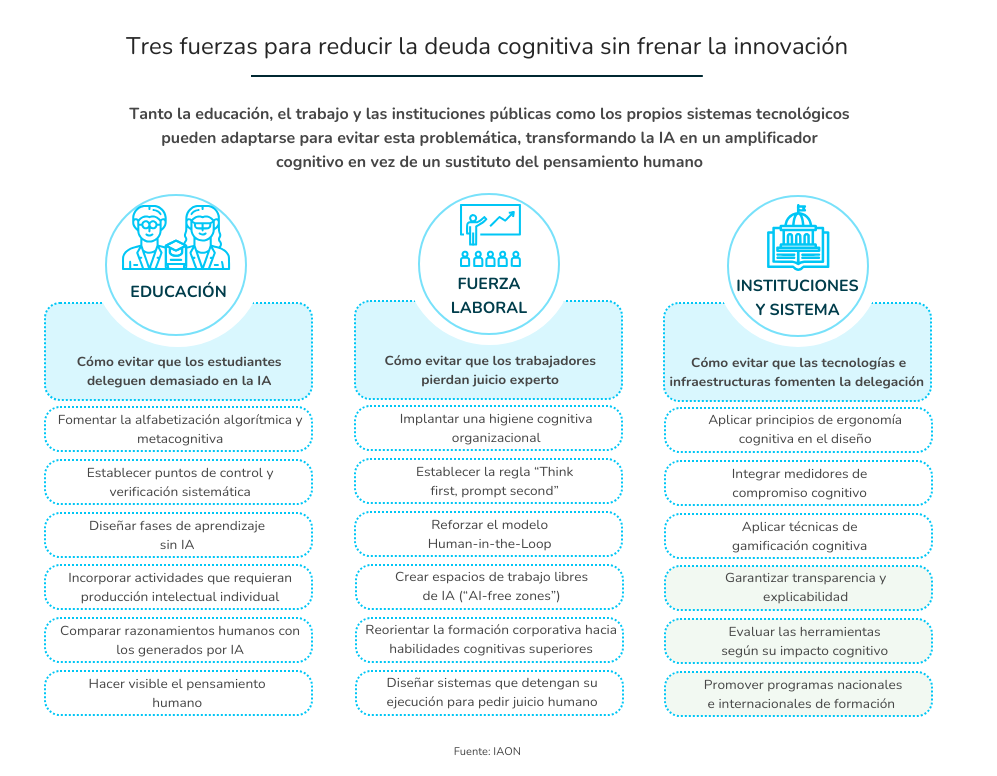

A la luz de estos riesgos, resulta imprescindible desplegar estrategias que mitiguen ya la futura deuda cognitiva, antes de que se convierta en un problema real. Los efectos observados no son inevitables y dependen de variables como la edad, la formación académica, el tipo de tareas que se delegan, la intensidad de uso, o el diseño mismo de las herramientas.

Si la integración de la IA no es deliberada, la tecnología tiende a fomentar prácticas de cognitive offloading excesivas y, para evitarlo, es necesario un rediseño simultáneo de los entornos educativos, los entornos laborales y los sistemas tecnológicos que regulan nuestra interacción con la IA.

Este rediseño se rige por un principio transversal de pensar primero, optimizar después.

Los jóvenes son el grupo más expuesto a los riesgos de la deuda cognitiva, no solo utilizan la IA con mayor frecuencia, sino que lo harán durante más tiempo a lo largo de su vida. Los estudios muestran una relación clara entre uso intensivo de estas herramientas y pérdida progresiva de habilidades cuando la interacción se vuelve pasiva. Por ello, los entornos educativos deben transformarse para que la IA pueda funcionar como un estímulo cognitivo, no como un atajo.

Es recomendable desarrollar la alfabetización algorítmica y metacognitiva. Los estudiantes deben entender por qué usan la IA, cuándo están interactuando con un modelo y qué limitaciones tiene. Esto implica normalizar puntos de control donde se revisa la calidad de las respuestas, enseñar a detectar errores y sesgos, y cultivar una cultura de verificación sistemática.

En paralelo, el aprendizaje es más profundo cuando el alumnado genera pensamiento propio antes de recibir ayuda externa. Esto exige rediseñar las dinámicas del aula para que ciertas etapas del trabajo se realicen sin IA, premiando procesos como el razonamiento, la iteración, o la reflexión tanto como los resultados finales. Esto es posible mediante el uso de portfolios, diarios u otras actividades proactivas que obliguen a mantener actividad mental constante.

La mejor protección contra la dependencia cognitiva es hacer visible el pensamiento. Los centros educativos deben promover actividades donde se describa el proceso seguido antes de usar IA, se comparen razonamientos humanos con los generados por la herramienta y se justifique la utilidad o necesidad de recurrir a ella en cada fase[20].

En el ámbito laboral, el riesgo cognitivo no proviene de la IA en sí, sino de implementaciones pasivas que relegan al profesional a un rol de supervisión superficial. Si el flujo de trabajo se organiza en torno a las acciones de la IA, la capacidad analítica se erosiona rápidamente. Es por ello por lo que las organizaciones necesitan culturas y estructuras que preserven el núcleo intelectual del trabajo humano.

Una primera medida es institucionalizar una higiene cognitiva organizacional, análoga a los manuales de ciberseguridad o las políticas de gobernanza de datos. Estos tres principios pueden marcar la diferencia:

A medida que la IA automatiza tareas rutinarias, los programas de formación corporativa deben reorientarse hacia habilidades superiores, como el pensamiento crítico, la creatividad, la resolución compleja de problemas o el diseño y razonamiento ético.

Modelos como la Taxonomía de Bloom permiten distribuir funciones entre humanos e IA, garantizando que los profesionales operen en los niveles cognitivos más altos mientras delegan solo tareas de niveles inferiores.

El enfoque HITL también debe integrarse completamente en el diseño de sistemas. Creando inteligencias artificiales que detiene su ejecución para solicitar juicio humano, interfaces que explican cómo llegaron a una respuesta, herramientas que exigen reflexión activa y prompts diseñados para evitar la aceptación automática.

Las organizaciones no deberían limitarse a adquirir soluciones genéricas, sino encargar tecnologías pensadas desde el inicio para colaboración humano-máquina[21].

La mitigación de la deuda también depende de un rediseño consciente de las propias herramientas digitales. Se necesita avanzar hacia una ergonomía cognitiva para la IA, en la que las interfaces reduzcan la carga superficial y aumenten la carga útil, es decir, la que favorece análisis, comprensión y decisión informada.

Entre los elementos del diseño responsable destacan:

Existen conceptos emergentes como NeuroGuard de la agencia de relaciones públicas y marketing Sparknify que empiezan a pensar en crear sistemas concebidos como “compañeros cognitivos” que aseguran que la IA amplifique el pensamiento humano en lugar de reemplazarlo[22].

Por último, las políticas públicas deben reconocer que la salud cognitiva es un componente central de la soberanía digital. Los gobiernos deben establecer marcos que evalúen el impacto cognitivo de las herramientas antes de su despliegue, exigir transparencia y verificación humana en ámbitos sensibles y promover guías de uso consciente tanto en instituciones educativas como administrativas.

Asimismo, es crucial invertir en programas nacionales de alfabetización algorítmica y metacognitiva que garanticen que toda la población pueda pensar críticamente en un entorno mediado por IA[23].

La deuda cognitiva revela el reverso de la revolución de la IA. Mientras celebramos su capacidad para acelerar tareas, ampliar nuestras habilidades y simplificar la complejidad, resalta una verdad incómoda, cuanto más delegamos en la tecnología, menos ejercitamos las capacidades que definen nuestra humanidad intelectual.

La integración masiva de la IA en la vida cotidiana, en el trabajo, en la educación y hasta en la información que consumimos, ha hecho visible la progresiva renuncia al esfuerzo cognitivo propio.

A lo largo de este análisis hemos constatado que la relación entre inteligencia humana e inteligencia artificial no es neutra. No es un vínculo de sustitución automática ni un complemento garantizado. Es una relación moldeable, profundamente dependiente de cómo decidamos incorporar la IA en nuestras prácticas mentales.

La tecnología, por sí sola, no deteriora la cognición, es el uso acrítico, la delegación prematura y la aceptación automática de sus respuestas lo que activa esta tendencia hacia la erosión del pensamiento crítico, la atención y la autonomía intelectual.

Los riesgos de no actuar son evidentes y puede desembocar en una sociedad donde el pensamiento profundo se vuelva excepcional, donde la creatividad sea menos diversa y donde el juicio individual quede subordinado a sistemas que muchos no comprenden. Lo que hoy se aprecia en individuos puede convertirse en fenómenos colectivos.

Si esta trayectoria continúa sin correcciones, el futuro que se dibuja es un ecosistema cognitivo más estrecho y automatizado, en el que la IA actúa como primera instancia de pensamiento y no como herramienta para expandirlo.

En el fondo, esta problemática nos invita a pensar si queremos una IA que piense por nosotros o una IA que nos obligue a pensar mejor. Si buscamos respuestas rápidas, eso nos dará; si evitamos el esfuerzo, reforzará esa evitación; si aceptamos su output sin reflexión, nos devolverá conocimiento empaquetado.

Pero si la usamos como un socio intelectual exigente, uno que amplifica nuestras habilidades, que nos reta y que nos complementa, entonces podremos expandir nuestras capacidades a niveles que hoy apenas intuimos. Solo así, podremos aprovechar su potencial sin acumular una deuda mental que, de otro modo, acabarían pagando las generaciones futuras.

El verdadero reto no es adoptar la IA, el reto es seguir pensando.

[1] GRAND VIEW RESEARCH. Artificial Intelligence Market Size, Share & Trends Analysis Report. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.grandviewresearch.com/industry-analysis/artificial-intelligence-ai-market

[2] NETGURU. AI Adoption Statistics: How Businesses Use Artificial Intelligence in 2025. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.netguru.com/blog/ai-adoption-statistics

[3] ELFSIGHT. AI Usage Statistics: How People Use Artificial Intelligence in 2025. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://elfsight.com/blog/ai-usage-statistics/

[4] MASTERSTUDY.AI. 5 Ways Artificial Intelligence Is Transforming Daily Life in 2025. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://masterstudy.ai/blogs/5-ways-artificial-intelligence-is-transforming-daily-life-in-2025

[5] NETGURU. AI in the Workplace: How Artificial Intelligence Is Transforming Work in 2025. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.netguru.com/blog/ai-in-the-workplace

[6] MCKINSEY & COMPANY. Superagency in the Workplace: Empowering People to Unlock AI’s Full Potential at Work. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.mckinsey.com/capabilities/tech-and-ai/our-insights/superagency-in-the-workplace-empowering-people-to-unlock-ais-full-potential-at-work

[7] PROGRAMS.COM. AI in Education Statistics: Trends, Benefits and Challenges. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://programs.com/resources/ai-education-statistics/

[8] COMISIÓN EUROPEA. Special Eurobarometer 538: Europeans’ attitudes towards Artificial Intelligence. Octubre 2023. [Consultado el 12 – 11 – 2025] Disponible en: https://europa.eu/eurobarometer/surveys/detail/3222

[9] IAON. Observatorio IAON 2025: Radiografía de la Inteligencia Artificial en España. Julio 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.ia-on.es/wp-content/uploads/2025/07/Observatorio_IAON_2025.pdf

[10] PHYS.ORG. AI linked to eroding critical thinking skills, researchers warn. 22 de enero de 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://phys.org/news/2025-01-ai-linked-eroding-critical-skills.html

[11] SSRN. The Cognitive Costs of Artificial Intelligence: Evidence from Human–AI Interaction. Abril 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://papers.ssrn.comnova/sol3/papers.cfm?abstract_id=5082524

[12] HIPERMÉDULA. Impacto cognitivo del uso de la Inteligencia Artificial. Julio 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://hipermedula.org/2025/07/impacto-cognitivo-del-uso-de-la-inteligencia-artificial/

[13] ARXIV. Cognitive Offloading and the Rise of AI Dependence: Measuring the Impact on Human Reasoning. Junio 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://arxiv.org/pdf/2506.08872

[14] MIT MEDIA LAB. Your Brain on ChatGPT: Understanding the Cognitive Effects of AI Interaction. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.media.mit.edu/projects/your-brain-on-chatgpt/overview/

[15] SPRINGER. Cognitive Automation and Human Adaptation in the Era of Generative AI. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://link.springer.com/article/10.1140/epjs/s11734-025-01561-8

[16] MDPI. The Cognitive Consequences of Artificial Intelligence: From Assistance to Dependency. Enero 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.mdpi.com/2075-4698/15/1/6

[17] ARXIV. Neural Rewiring in the Age of Artificial Intelligence: Cognitive and Behavioral Adaptations. Agosto 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://arxiv.org/pdf/2508.16628

[18] SCIENCE DIRECT. Behavioral Shifts and Cognitive Plasticity under AI Mediation. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.sciencedirect.com/science/article/pii/S0001691825010388

[19] JOURNAL OF FUTURES STUDIES. On the Crisis and Democratization of Knowledge: The Sociopolitical Impact of AI and Knowledge Hierarchy. Septiembre 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://jfsdigital.org/2025-2/vol-30-no-1-september-2025/on-the-crisis-and-democratization-of-knowledge-the-sociopolitical-impact-of-ai-and-knowledge-hierarchy/

[20] ESCHOOL NEWS. Avoiding Cognitive Debt by Building Critical Thinking Skills. 29 de julio de 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.eschoolnews.com/digital-learning/2025/07/29/avoiding-cognitive-debt-by-building-critical-thinking-skills/

[21] BAY TECH CONSULTING. AI Strategy and the Rising Risk of Cognitive Debt. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.baytechconsulting.com/blog/ai-strategy-cognitive-debt-2025

[22] SPARKNIFY. Cognitive Collapse: MIT’s Alarming Study on ChatGPT and Sparknify’s Vision for a Smarter Human-AI Ecosystem. 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://www.sparknify.com/post/cognitive-collapse-mit-s-alarming-study-on-chatgpt-and-sparknify-s-vision-for-a-smarter-human-ai-en

[23] HIPERMÉDULA. Impacto cognitivo del uso de la Inteligencia Artificial. Julio 2025. [Consultado el 12 – 11 – 2025] Disponible en: https://hipermedula.org/2025/07/impacto-cognitivo-del-uso-de-la-inteligencia-artificial/